SIGCOMM ’25: ACM SIGCOMM 2025 Conference September 8 – 11, 2025 Coimbra, Portugal

1. 课题背景与现有方案的局限性

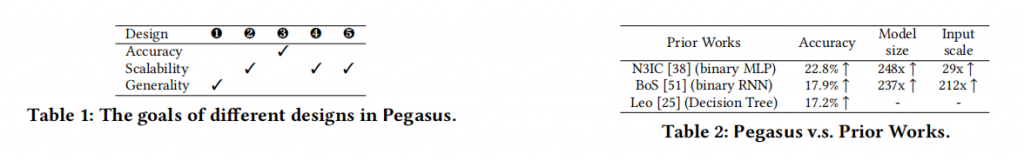

随着网络流量的爆炸式增长,在数据平面直接进行实时智能分析已成为必然趋势。然而,现有的研究方案在应对复杂的深度学习(DL)模型时面临严重的性能瓶颈。传统的“计算简化”类方案,如 N3IC 等,主要依赖于对神经网络进行极度的量化或二值化处理,虽然这降低了对交换机算力的要求,但由于丢失了大量的特征数值精度,导致其在处理复杂分类任务时的准确率大打折扣。这种方案往往只能处理非常简单的线性任务,一旦面对具有复杂非线性特征的流量数据,其预测结果的可靠性便无法满足工业级网络安全和管理的需求。

与此同时,另一种“计算绕过”类方案,如 BoS,试图通过预先存储输入到输出的映射表来完全避免实时计算。这种方法的致命缺陷在于其极差的扩展性:随着输入特征维度的增加,可能的组合空间呈指数级膨胀,这在学术上被称为“组合爆炸”问题。由于交换机的内存资源(如 SRAM 和 TCAM)极其宝贵且容量固定,这类方案往往只能支持极小规模的输入,无法应对现代网络协议中动辄数百比特的报文特征。因此,业界迫切需要一种既能保证计算精度,又能在线速环境下处理大规模、高维度输入的通用推理框架,这正是 Pegasus 课题的研究起点。

2. Pegasus 核心原语体系的设计逻辑

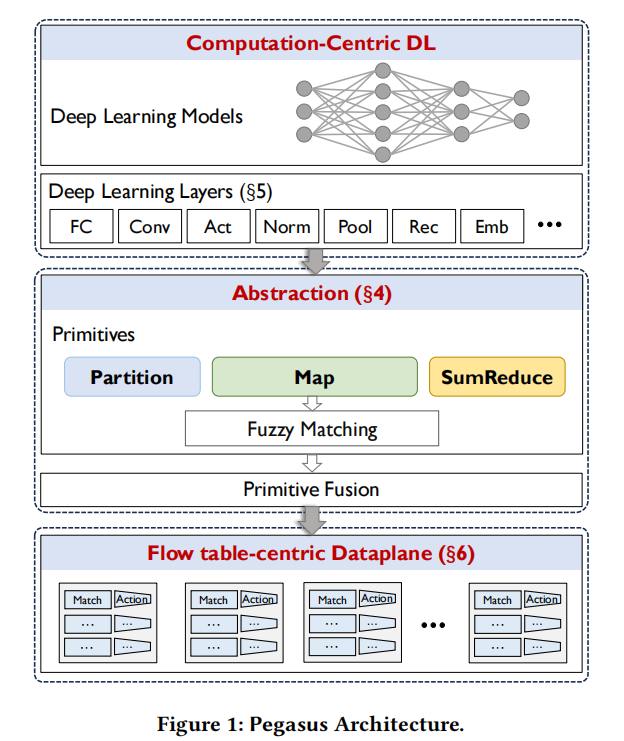

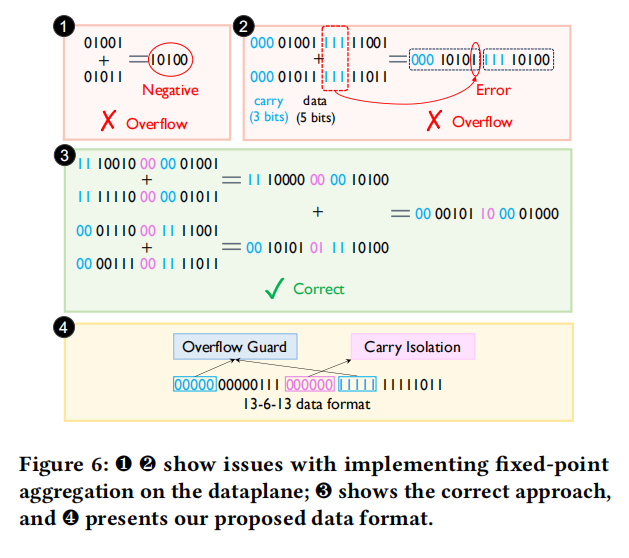

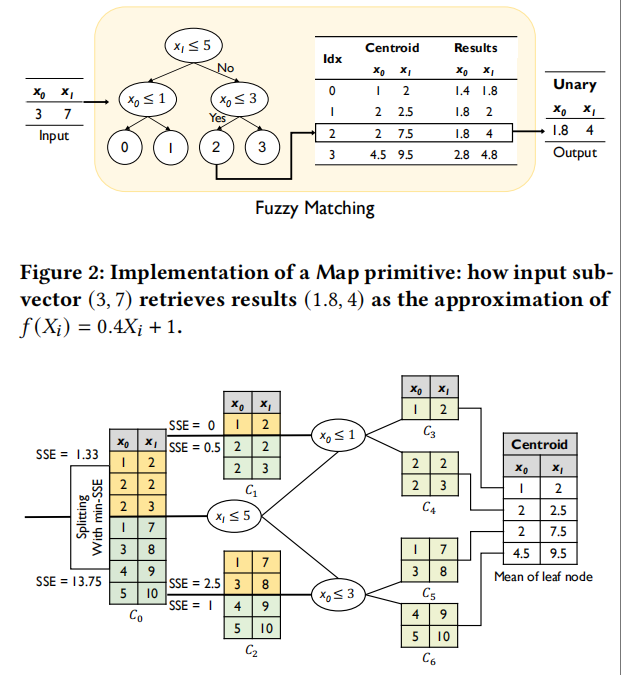

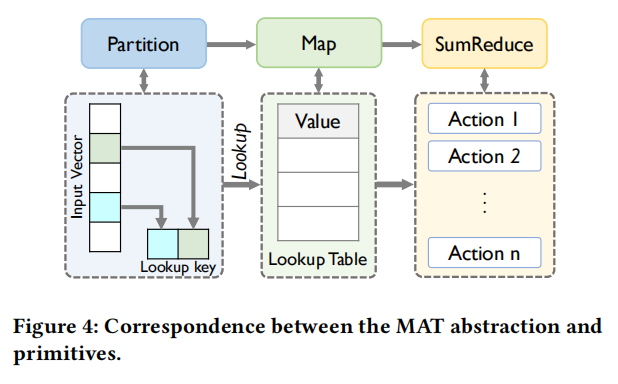

Pegasus 的核心贡献在于将复杂的深度学习计算抽象为三个基础原语:Partition(划分)、Map(映射)和 SumReduce(和归约)。Partition 原语的作用是将高维度的输入特征向量切分为多个低维的子向量,这种“分而治之”的策略能够将原本无法在单次匹配中完成的超大规模空间映射降维。Map 原语则利用交换机的匹配-动作表(MAT)并行查找每个子向量对应的中间计算结果。SumReduce 原语负责将这些分散的中间结果进行分层聚合,最终在交换机流水线的出口处输出完整的推理结论。这种原语化的设计逻辑,将 DL 运算从昂贵的浮点数矩阵运算转化为了交换机擅长的多级查表操作。

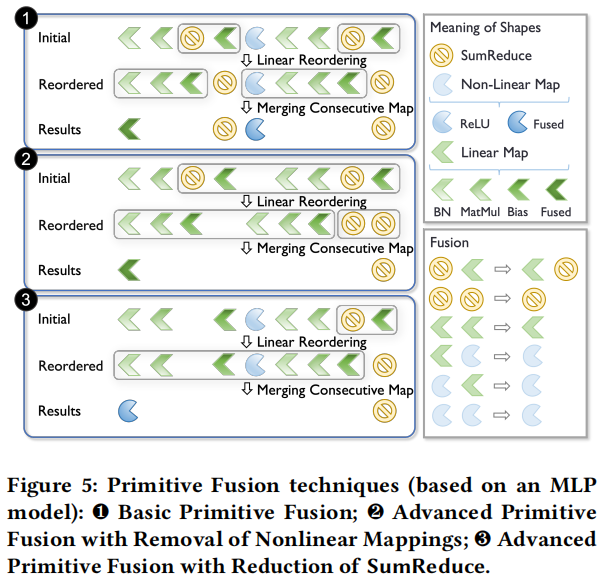

为了进一步优化资源利用率,Pegasus 引入了创新的“模糊匹配”(Fuzzy Matching)技术。它不再追求输入值的完全精确匹配,而是通过聚类算法将相近的输入值映射到同一个质心索引(Fuzzy Index)上。这种设计不仅极大地压缩了映射表所需的存储空间,还赋予了框架处理连续数值特征的能力。此外,通过“原语融合”(Primitive Fusion)技术,Pegasus 能够将诸如批归一化(Batch Normalization)、激活函数(ReLU/Sigmoid)和线性变换等多个连续的神经元操作合并到同一组映射表中完成。这种融合策略极大地节省了交换机的流水线阶段(Stages),使得在有限的硬件步数内执行更深层、更复杂的网络模型成为可能。

3. 支持多样化模型架构的通用性实现

Pegasus 不仅仅是一个针对特定任务的插件,而是一个具备高度通用性的框架,能够支持 MLP(多层感知机)、RNN(循环神经网络)、CNN(卷积神经网络)以及 AutoEncoder(自动编码器)等多种主流模型。在实现 CNN 时,Pegasus 巧妙地将卷积层的滑动窗口操作转化为数据平面上的字段偏移处理,通过 Map 原语并行提取空间特征;在处理 RNN 等具有时间序列特性的模型时,框架利用交换机内的寄存器(Registers)来存储隐藏状态(Hidden State),实现了跨报文的信息传递。这种对不同模型算子的灵活解构,证明了 Pegasus 作为底层推理引擎的强大普适性。

在软件层面,Pegasus 提供了一套完整的编译器套件,能够将用户训练好的 PyTorch 或 TensorFlow 模型自动转换为 P4 代码和对应的流表项。这一过程包括了自动化的量化策略、原语映射算法以及流水线资源调度优化。开发者无需深入了解交换机底层复杂的硬件逻辑,只需提供标准模型,Pegasus 就能在保证延迟和吞吐量的前提下,自动完成从高层算法到低层硬件配置的映射。这种“算法到硬件”的端到端自动化能力,极大地降低了在网络设备上部署深度学习算法的门槛,使得网络工程师能够像在 GPU 上一样灵活地部署 AI 策略。

4. 实验评估与性能指标分析

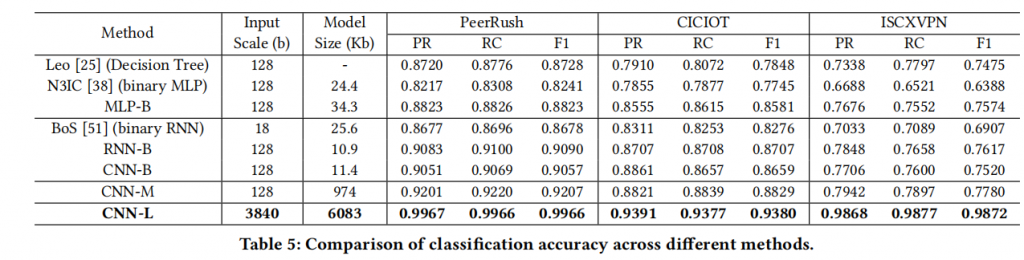

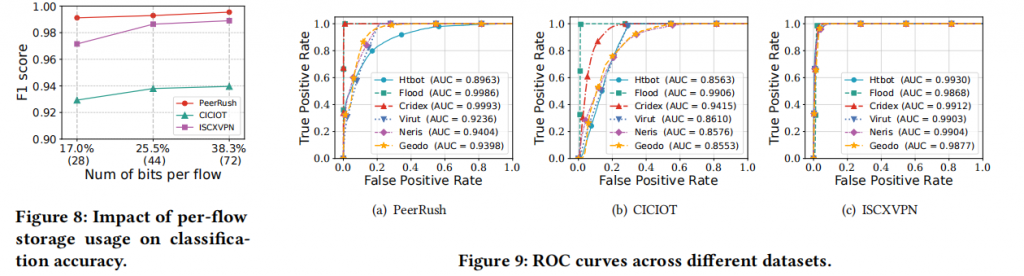

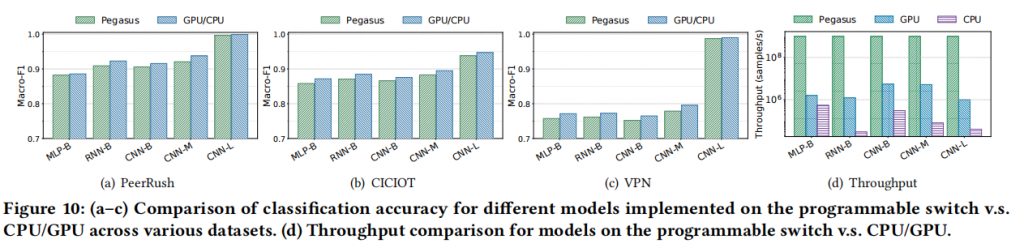

研究团队在真实的 Barefoot Tofino 硬件交换机上对 Pegasus 进行了严格的评估,覆盖了多个权威的网络流量数据集。实验数据表明,Pegasus 在所有测试的模型架构中均表现出显著的优越性,其预测精度相比之前的最先进方案(SOTA)平均提升了 22.8%。特别是在处理涉及长序列、高维特征的入侵检测和协议识别任务时,由于其采用了模糊匹配和混合精度技术,Pegasus 能够在极低的硬件开销下,保持与离线服务器端推理几乎一致的准确率。这种精度的跃升,标志着数据平面推理从“可用”真正走向了“可靠”。

在资源扩展性方面,Pegasus 展现出了碾压性的优势。相比于 BoS 等方案,它支持的模型参数量扩大了 248 倍,输入维度支持能力提升了 212 倍。在吞吐量方面,Pegasus 成功实现了线速处理,即使是在满负荷的 Tbps 级网络环境中,其引入的额外延迟也仅在微秒量级,完全可以忽略不计。此外,实验还通过对比不同数量的质心(Centroids)对精度的影响,验证了框架在资源限制与性能表现之间的良好平衡。这些量化指标充分证明了 Pegasus 是目前已知唯一能够同时兼顾高吞吐、低延迟、高精度和强扩展性的数据平面 AI 推理方案。

5. 结论与未来研究价值

Pegasus 的成功研发彻底改变了业界对可编程交换机“计算能力贫瘠”的固有认知。它证明了虽然交换机的指令集极其简化,但通过巧妙的抽象建模和原语重构,同样可以承载原本属于 GPU 的深度学习负载。Pegasus 提供了一套标准化的设计范式,将网络领域的需求与 AI 领域的计算力进行了完美的工程衔接。它不仅为实时的网络流量清洗、智能路由控制和动态拥塞管理提供了技术基础,也为未来“网络即计算”(Network-as-Computing)的愿景提供了极具说服力的实践范例。

从更深远的意义来看,Pegasus 的开源和推广将推动智能数据平面生态系统的发展。它所提出的模糊匹配和原语融合思想,可以被进一步借鉴到其他资源受限的硬件环境(如边缘计算设备或嵌入式 FPGA)中。未来的研究方向可能包括如何在 Pegasus 框架下实现模型的动态在线更新,以及如何进一步支持更加前沿的 Transformer 等注意力机制模型。总而言之,Pegasus 是数据平面智能化进程中的一座里程碑,它为构建更安全、更高效、更具感知力的下一代未来网络奠定了坚实的算法与架构基石。