①Introduction

多智能体强化学习一直被认为是强化学习中最复杂的一类问题。难点不仅在于每个智能体都要学策略,更在于多个智能体之间必须协同更新,才能提升整体收益。也正因此,这一领域长期依赖一些“折中方案”,比如集中训练、分布执行,通过引入全局信息来缓解训练难度。但这些方法始终存在一个根本问题:它们并没有真正解决多智能体之间的交互建模问题。很多方法要么依赖参数共享,要么依赖复杂的价值分解结构,在一些场景中甚至会失效。与此同时,另一条技术路线正在快速崛起——序列建模。从语言到图像,再到强化学习,越来越多问题被统一为“序列预测”,并取得了非常强的效果。那么问题来了:多智能体决策,本质上是不是也可以看成一种序列生成过程?

②From MARL to Sequence Modeling:关键思想的转变

这篇论文的核心洞察在于:多智能体的联合决策,其实可以拆解成一个按顺序进行的决策过程。传统观点认为,多个智能体是在同一时刻同时做决策的,因此需要在一个指数级的联合动作空间中搜索。但论文基于优势分解理论指出,一个联合决策可以表示为多个“逐步决策”的累加过程。直观理解就是:可以让智能体按照某种顺序,一个接一个地做决策,后面的智能体在做决定时,可以参考前面智能体的行为。这样一来,一个复杂的多智能体问题,就被转化成了一个有依赖关系的序列决策问题。这一步其实非常关键,相当于把问题“降维”到了一个更结构化的空间中。

③Multi-Agent Transformer

在这个新视角下,作者提出了核心模型——Multi-Agent Transformer。可以把它理解为一个“多智能体版本的序列生成模型”:输入是所有智能体的观测信息,输出是对应的动作序列。模型整体采用类似编码器—解码器的结构:前半部分负责提取所有智能体之间的交互关系,把观测信息转成高层表示;后半部分则按照顺序逐个生成每个智能体的动作。这里最关键的设计在于:模型通过一种“带约束的注意力机制”,保证每个智能体在决策时,只能看到已经做出决策的前序智能体,而不能看到未来信息。这一点,使整个过程天然符合“序列生成”的逻辑。这样的建模方式带来了几个非常重要的好处:一是把原本指数级复杂的问题转化为线性复杂度;二是可以在训练阶段实现并行更新,提高效率;三是能够自然支持不同数量和类型的智能体,扩展性更强。

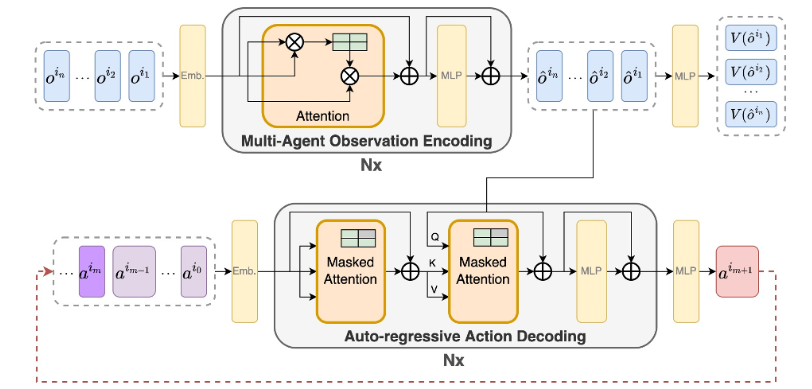

如上图所示,这张图展示了 Multi-Agent Transformer 的整体架构,其核心是一个编码器—解码器结构,用于将多智能体决策过程转化为序列生成问题。在上半部分,编码器接收所有智能体的观测信息,并通过嵌入层和多层注意力机制进行处理。这一过程的关键作用是建模不同智能体之间的交互关系,使得输出的表示不仅包含单个智能体的状态信息,还融合了整体环境中各智能体之间的依赖结构。在下半部分,解码器负责生成各个智能体的动作。与传统多智能体方法中“同时决策”不同,这里采用按顺序逐步生成的方式。解码器通过带掩码的注意力机制,使每个智能体在决策时只能利用已经生成的前序智能体信息,而无法访问后续信息,从而保证整个过程符合序列生成的逻辑。这种设计使得每个智能体的决策不仅依赖于环境观测,还能够显式考虑其他智能体的行为,从而更好地刻画协同关系。同时,由于采用统一的序列建模框架,该方法能够在不同数量和类型的智能体场景下保持良好的扩展性。整体来看,该架构实现了从“多智能体并行决策”到“序列化协同决策”的转变,是将多智能体强化学习统一到序列建模框架中的关键一步。

④Experiments

为验证所提方法的有效性,论文在多个经典多智能体强化学习基准上进行了系统实验,包括 SMAC(StarCraft II)、Multi-Agent MuJoCo、Bi-DexHands 以及 Google Research Football 等任务,覆盖了同质与异质智能体两类典型场景。

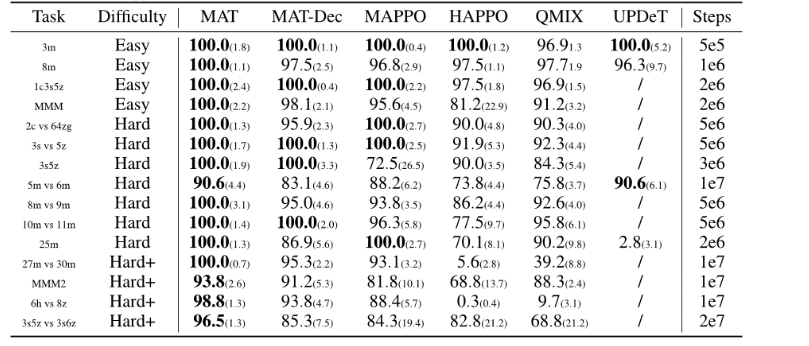

(1)在 SMAC 任务上,论文报告了不同方法在多种难度任务下的胜率表现(如上表所示)。整体来看,MAT 在大多数任务中均取得最优或接近最优结果,尤其在中高难度任务中优势明显。例如:

- 在 3s5z(Hard)任务中,MAT 达到 100% 胜率,而 MAPPO 为 72.5%,HAPPO 为 90.0%

- 在 MMM2(Hard+)任务中,MAT 为 93.8%,明显高于 MAPPO(81.8%)和 HAPPO(68.8%)

- 在 6h vs 8z(Hard+)任务中,MAT 达到 98.8%,而 HAPPO 仅为 0.3%

在部分简单任务(如 3m、8m)中,各方法性能接近,但随着任务复杂度提升,MAT 的优势逐渐扩大。

MAT 在复杂协作决策场景中,能够更有效地建模智能体之间的交互关系,从而提升整体策略质量。

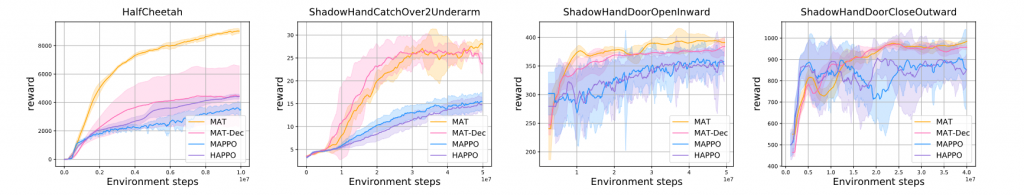

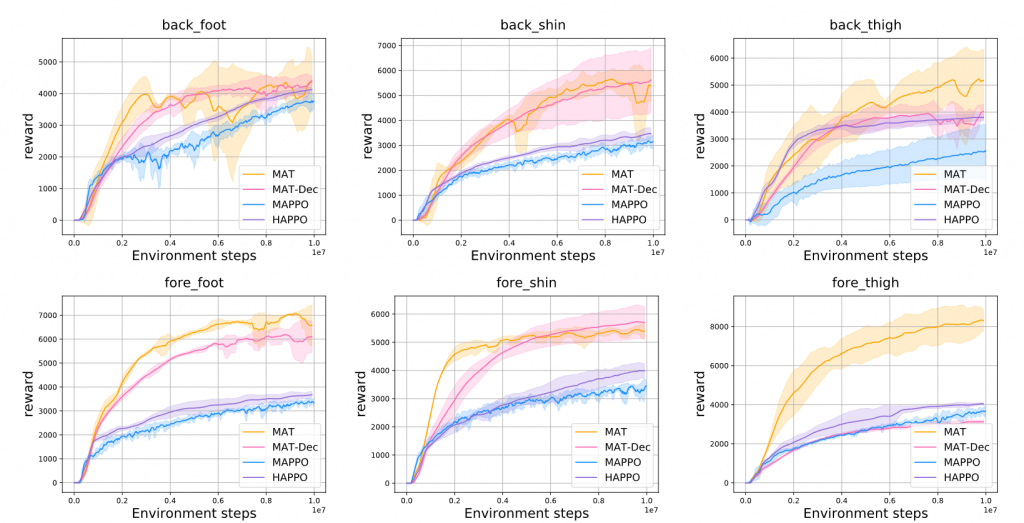

(2)在Multi-Agent MuJoCo 与 Bi-DexHands在连续控制任务中,论文进一步验证了方法在异质智能体场景下的表现(如上图所示)。从图中可以观察到:

- 在 HalfCheetah 任务中,MAT 的最终回报显著高于 MAPPO 和 HAPPO,并且收敛速度更快

- 在 机械手协作任务(如 Catch、Door Open/Close)中,MAT 始终位于最优曲线位置,且训练波动较小

- MAT-Dec(去掉序列解码结构)性能明显下降,说明序列建模机制是性能提升的关键来源

此外,论文指出MAPPO 更适合同质智能体(参数共享有效),HAPPO 更适合异质智能体(顺序更新)而MAT 在两类场景中均表现稳定。说明MAT 通过统一的序列建模框架,同时兼顾了表达能力与泛化能力。

⑤Conclusion

这篇论文最重要的意义,其实不只是提出了一个性能更强的模型,而是给出了一个新的视角:把多智能体强化学习统一到序列建模框架中。这种转变带来的影响是深远的。它意味着,多智能体问题不再需要单独设计复杂结构,而是可以直接借助序列模型的发展成果来解决。从更宏观的角度来看,这项工作很可能是一个信号:未来的多智能体强化学习,可能会像自然语言处理一样,逐步走向统一建模和大模型化。