Proceedings of the ACM on Management of Data, Volume 3, Issue 3 (June 2025)

hps://doi.org/10.1145/3725360

EISSN: 2836-6573

1. 摘要(Abstract)

SWASH提出了一种专为动态图神经网络(DGNN)分布式训练设计的全新通信框架,核心目标是解决滑动窗口训练模式下通信开销大、现有分区策略不兼容以及缓存复用效率低三大挑战。传统分布式DGNN训练框架(如快照分区、Chunk-based分区和L-hop缓存免通信顶点分区)在滑动窗口场景下存在严重不匹配:快照分区难以支持跨窗口通信优化,Chunk-based分区虽减少单快照通信但忽略滑动窗口的时序特性,而现有缓存技术仅限于单机内部聚合结果复用,无法有效降低分布式环境下的网络通信量。

SWASH通过引入滑动窗口为基础的缓存共享(Sliding Window-based Cache Sharing)技术,实现了通信与缓存的灵活融合。具体而言,系统提出了一套支持通信比例调整、时间选择、超参数设置以及自适应调度的柔性通信框架,同时设计了轻量级LightMetis分区策略,仅针对滑动窗口训练特点进行加权图划分,大幅降低分区和通信开销。为了缓解因减少通信导致的精度下降,SWASH进一步提出基于滑动窗口的边界顶点嵌入缓存共享机制,在不同滑动窗口之间复用历史嵌入信息,实现通信量与模型精度的平衡。

实验结果表明,SWASH在六个真实数据集和三种真实环境上,相比现有最先进滑动窗口框架平均加速9.44倍,同时保持了全通信、无缓存训练框架的精度。该工作不仅填补了分布式DGNN训练在滑动窗口模式下的系统空白,还为大规模动态图学习提供了可扩展、可灵活配置的通信优化范式,具有重要的理论创新价值和工程实用意义。

2. 引言(Introduction)

动态图神经网络(DGNN)在交通流量预测、社交网络分析、流行病传播预测等实际应用中展现出强大能力,其核心优势在于能够同时捕捉图的属性、结构以及时序演化特性。然而,大规模动态图训练面临极高的计算和通信开销:DGNN需通过RNN建模时序动态,导致通信量和计算量是静态GNN的T倍(T为快照数)。滑动窗口训练虽能将复杂度从O(T)降低至O(Ns)(Ns<T),但在单机无法承载超大规模动态图时,分布式训练成为必然选择。

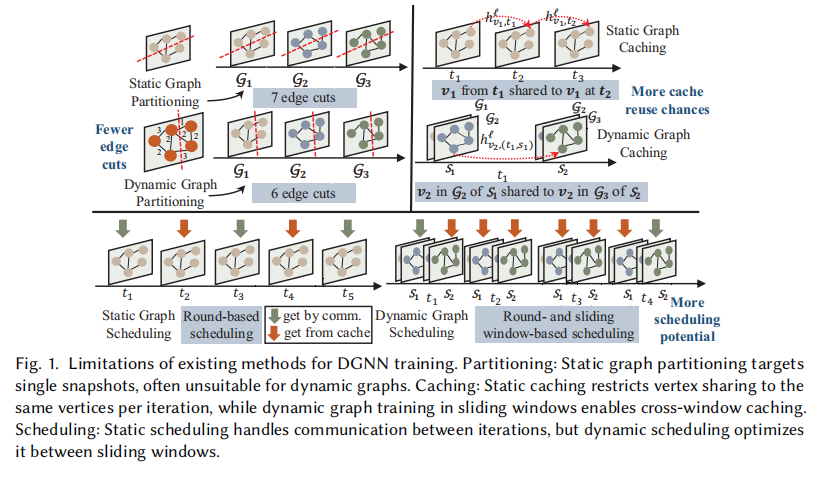

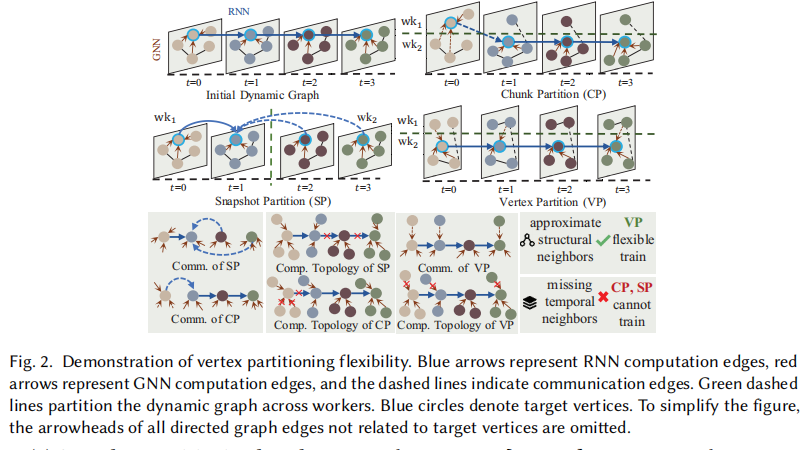

现有分布式框架主要面临三大挑战:一是全通信导致的巨大网络开销;二是现有分区策略(如快照分区、Chunk-based分区)无法有效适配滑动窗口训练,跨快照通信优化困难;三是缓存技术仅局限于单快照内部复用,无法利用滑动窗口之间的时序相关性进一步降低通信。SWASH正是针对这些痛点而设计,它首次提出了一套柔性通信框架,支持任意通信比例、任意通信时机以及自适应调度策略。同时,系统创新性地引入轻量级分区策略和滑动窗口缓存共享机制,在保证模型精度的前提下大幅降低通信和同步开销。

论文以真实动态图数据集为例,系统性地分析了现有方法的局限,并通过理论分析与大量实验验证了SWASH的有效性。实验表明,SWASH在保持全通信框架精度的同时,实现了平均9.44倍的训练加速,充分证明了其在可扩展DGNN训练中的重要价值。该工作不仅为动态图学习提供了实用系统框架,也为分布式机器学习中的通信优化提供了新的思路。

3. 背景与动机(Background and Motivation)

动态图通常被建模为一系列离散快照序列,每个快照包含顶点集、边集以及对应的特征。DGNN训练需同时处理空间邻居聚合(GNN部分)和时序动态建模(RNN部分),导致通信包括GNN通信(同快照邻居嵌入交换)和RNN通信(跨快照隐藏状态传递)。滑动窗口训练通过在每个迭代中使用连续Ns个快照代替完整T个快照,显著降低了计算复杂度,同时引入样本多样性提升泛化能力。

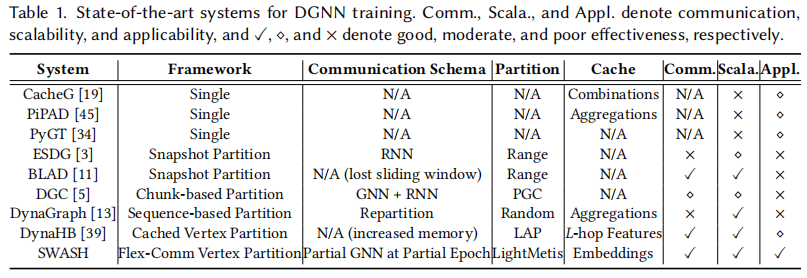

然而,现有分布式DGNN框架在滑动窗口模式下存在明显不适配:快照分区虽消除GNN通信,但无法支持跨机器滑动窗口训练;Chunk-based分区虽融合结构与时序邻居,但仍需两轮同步且不适合滑动窗口;顶点分区虽支持滑动窗口,却因静态图设计导致跨快照通信优化不足。此外,现有缓存技术(如CacheG、PiPAD)主要针对单机计算优化,无法有效减少分布式场景下的网络通信,且忽略滑动窗口之间的嵌入共享机会。

SWASH的动机正是填补这一空白:通过柔性通信框架实现通信比例和时机的动态调整,通过轻量级LightMetis分区降低跨窗口通信,通过滑动窗口缓存共享机制复用历史嵌入,从而在分布式环境下实现高效、可扩展的DGNN训练。该设计不仅解决了现有方法的三大挑战,也为后续动态图系统研究提供了重要参考。

4. 系统框架与分区策略(System Framework and Partitioning)

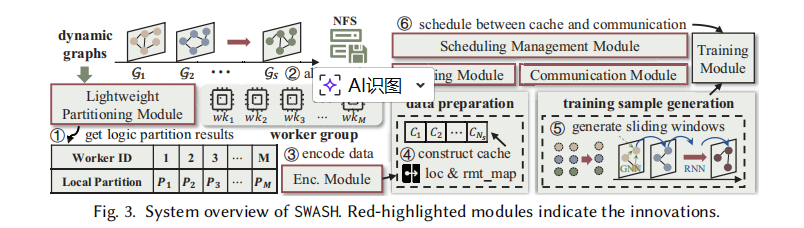

SWASH整体架构包含五个核心模块:轻量级分区模块、编码模块、通信模块、缓存模块和调度管理模块。分区模块首先对动态图进行轻量级划分,生成顶点到工作节点的映射表;编码模块负责本地数据加载、索引映射及GPU缓存构建;通信与缓存模块则根据调度策略决定边界顶点是走网络通信还是直接从缓存读取;调度管理模块负责训练样本生成、通信时机选择以及缓存更新协调。

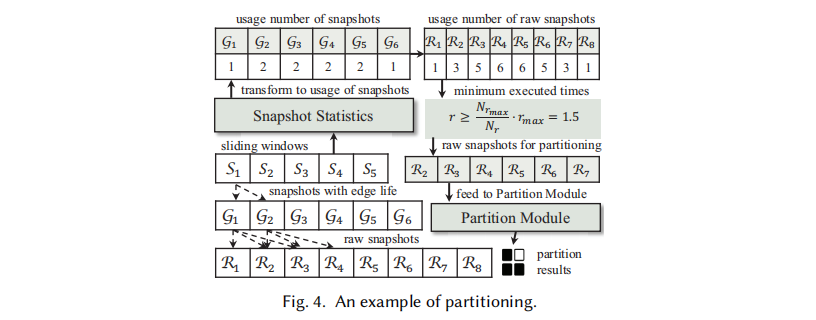

在分区策略上,SWASH提出LightMetis算法,专门针对滑动窗口训练特点设计。它首先计算原始快照的使用频率(考虑滑动窗口长度Ns和边生命周期z的双重影响),然后仅保留高频原始快照,构建加权合并图,最后使用Metis进行加权划分。该策略显著降低了分区时间和后续通信开销,同时保证同一顶点在所有快照中被分配到同一工作节点,彻底消除RNN通信。

实验验证显示,LightMetis相比传统Metis分区在动态图上通信量更低、分区开销更小,为后续柔性通信和缓存共享奠定了高效基础。该模块的设计充分体现了SWASH对滑动窗口训练的深度适配,是系统实现高性能的关键创新之一。

5. 柔性通信与缓存共享技术(Flexible Communication and Cache Sharing)

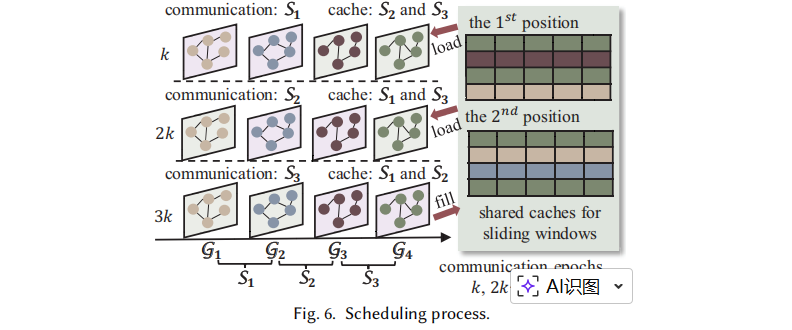

SWASH的核心创新在于提出了一套柔性通信框架,支持三个关键超参数:通信间隔k(每k个epoch通信一次)、通信窗口数s(每个epoch内通信s个滑动窗口)以及通信比例p(每个快照通信p比例的边界嵌入)。通过这些参数,用户可灵活平衡通信开销与模型精度。

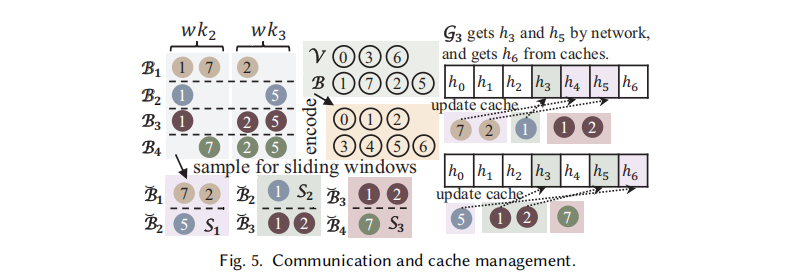

为降低通信时的子图重构开销,系统采用合并边界编码技术,将所有快照的边界顶点集合并编码为统一索引,减少重复编码和内存占用。同时,SWASH提出滑动窗口为基础的缓存共享机制:每个滑动窗口维护Ns个嵌入矩阵,同一位置的快照因经历相同RNN变换而具有较高相似性,因此前一个窗口的嵌入可直接共享给后续窗口,从而大幅减少跨窗口通信频率。

调度模块进一步引入自适应策略,根据实时通信代价与缓存命中率动态调整超参数,实现通信与缓存的智能切换。该技术不仅有效缓解了精度下降问题,还显著提升了整体训练效率,是SWASH在分布式DGNN训练中实现高加速比的关键所在。

6. 实验评估(Evaluation)

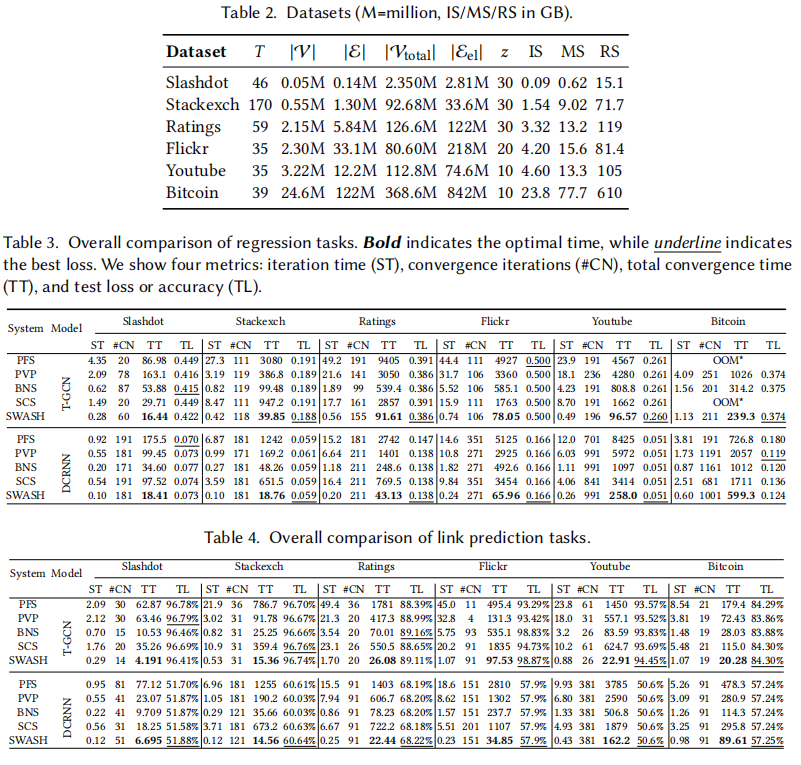

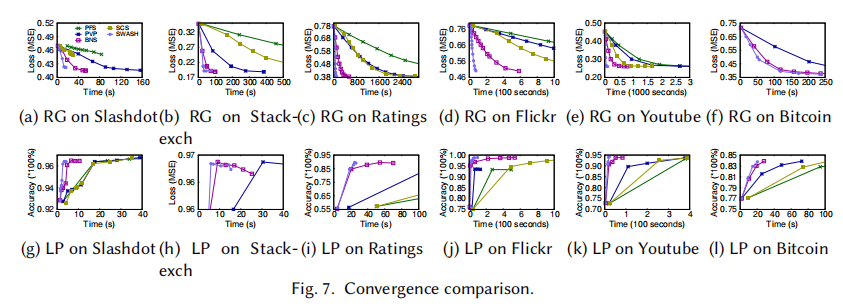

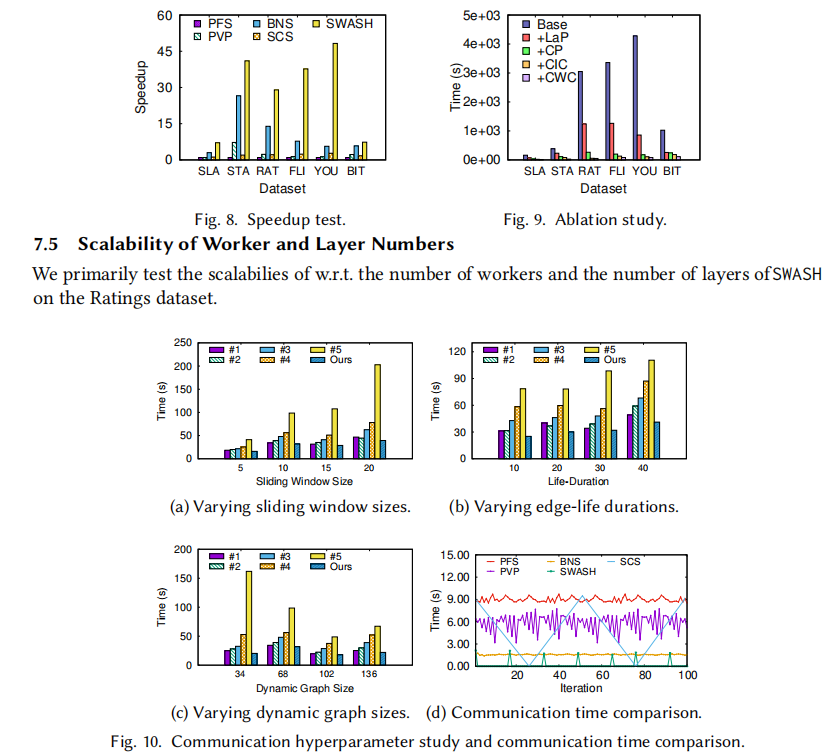

论文在六个真实动态图数据集上进行了全面实验,涵盖交通、社交、疫情等多种场景,并在单机、多机CPU/GPU混合环境上验证系统性能。相比现有最先进滑动窗口框架(DynaGraph、DynaHB等),SWASH平均实现9.44倍训练加速,同时在精度上与全通信、无缓存框架持平。

消融实验进一步验证了各模块贡献:LightMetis分区显著降低通信量,柔性通信框架通过超参数调优实现最优平衡,滑动窗口缓存共享在减少通信的同时有效维持精度。敏感性分析显示,SWASH对不同Ns、z等参数具有良好鲁棒性,在大规模动态图上扩展性突出。

这些结果充分证明了SWASH在实际部署中的实用价值,为大规模DGNN训练提供了高效、可扩展的系统解决方案。

7. 贡献与结论(Contributions and Conclusion)

SWASH的主要贡献包括:(1)提出柔性通信框架,支持通信比例、时机和自适应调度,有效解决通信开销问题;(2)设计轻量级LightMetis分区策略,针对滑动窗口训练特点优化通信;(3)创新滑动窗口缓存共享机制,在分布式环境下实现跨窗口嵌入复用;(4)通过大量实验验证系统在加速和精度上的双重优势。

论文结论指出,滑动窗口训练虽提升了DGNN效率,但现有分布式框架的通信与分区不适配已成为主要瓶颈。SWASH通过系统性创新,成功实现了通信优化与精度保持的平衡,为大规模动态图学习提供了实用框架。该工作不仅具有重要的学术创新价值,也为工业界部署DGNN应用提供了可落地的系统参考,未来可进一步扩展到更多动态图场景。