SIGCOMM ’25: ACM SIGCOMM 2025

Conference

September 8 – 11, 2025

Coimbra, Portuga

1. 摘要(Abstract)

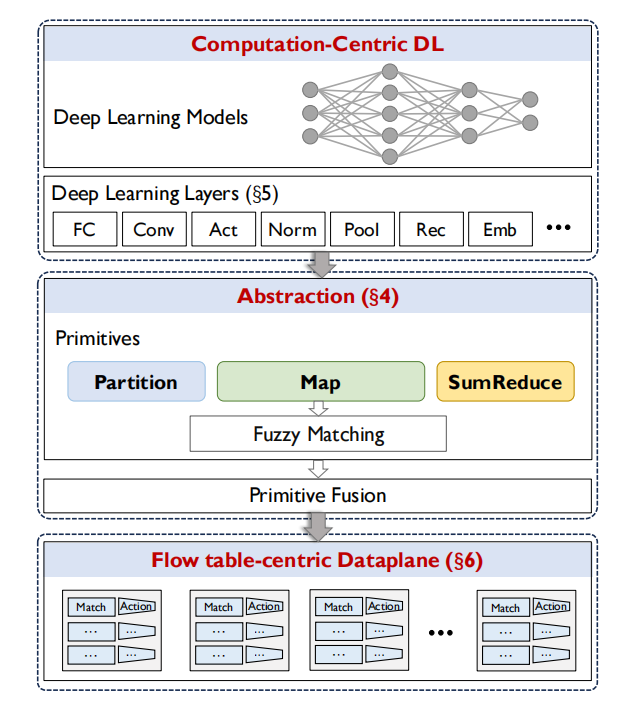

Pegasus针对当前Intelligent DataPlane(IDP)中深度学习(DL)推理面临的三大核心限制——精度下降、可扩展性差、泛化能力不足——提出了一个通用框架。它将DL操作抽象为三种面向数据平面的原语:Partition(分区)、Map(映射)和SumReduce(求和归约)。通过这些原语,Pegasus实现了对MLP、RNN、CNN、AutoEncoder等多种模型的直接支持,无需修改硬件。

论文强调,Pegasus采用全精度权重+定点激活值,并引入Fuzzy Matching(模糊匹配)和Primitive Fusion(原语融合)技术,进一步提升精度与资源利用率。在P4可编程交换机上的实验显示,Pegasus在精度上平均提升最高22.8%,模型规模扩大248倍,输入规模扩大212倍,实现了真正线速的通用DL推理。

2. 引言(Introduction)

传统IDP主要依赖匹配-动作表(MAT)抽象,但MAT与DL推理的计算需求严重不匹配。现有方案分为两类:计算简化(如N3IC的二值化MLP)和计算绕过(如BoS的输入-输出映射表)。两者均存在精度损失(二值化导致数值范围缩小)、可扩展性受限(表项爆炸或阶段不足)和泛化能力差(仅支持特定层或特定模型)的问题。

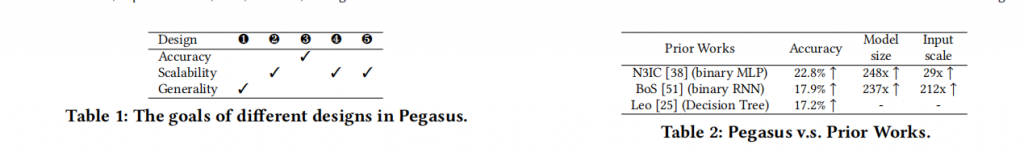

Pegasus提出五项紧密耦合的设计:①将DL操作转化为三种原语;②采用Partition+Map+SumReduce流程;③使用全精度权重与定点激活;④引入Fuzzy Matching减少查找次数;⑤采用Primitive Fusion合并操作。实验表明,该框架在Tofino2交换机上成功部署多种模型,显著超越N3IC、BoS和Leo等现有工作。

3. 背景与动机(Background and Motivation)

深度学习模型由FC、Conv、Act、Norm、Pool、Rec、Emb等多种层组成,每层包含MatMul、元素级变换、多输入操作等复杂计算。而PISA架构仅支持整数加减、移位、位运算,不支持乘法、浮点数和指数运算,资源也极为有限(20个MAT阶段、有限SRAM/TCAM)。

现有工作N3IC通过XNOR+popcnt实现二值MLP,但精度显著下降且无法支持其他层;BoS通过完整映射表绕过计算,却因2^n表项爆炸而输入规模极小(18bit)。两者均无法同时满足精度、可扩展性和泛化需求。Pegasus的动机正是填补这一空白,实现商品化可编程交换机上的通用、高精度、大规模DL推理。

4. 设计概述(Design Overview)

Pegasus的核心是三种原语:

- Partition:将高维输入向量拆分为多个低维子向量;

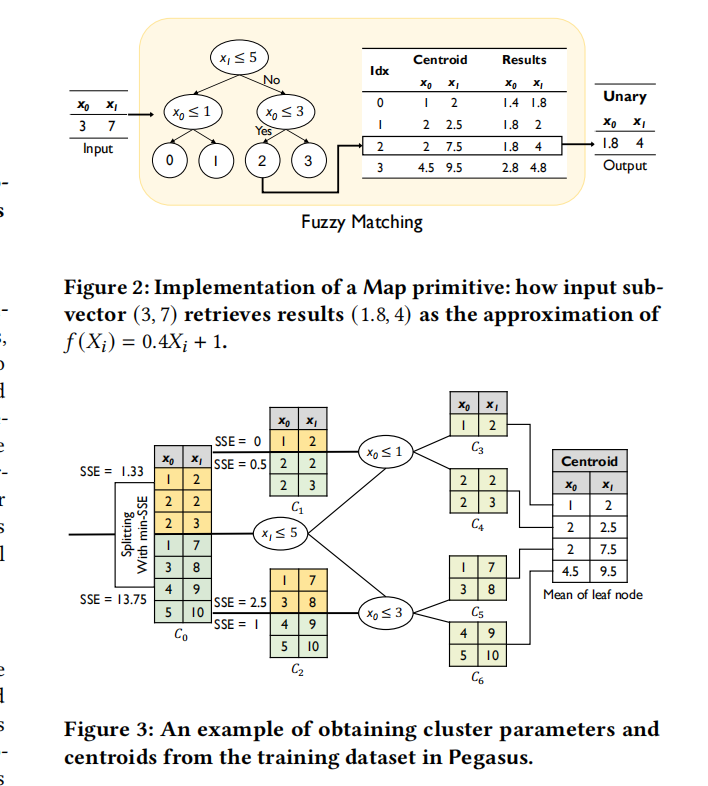

- Map:对每个子向量进行并行函数映射(借助Fuzzy Matching);

- SumReduce:对映射结果进行元素级求和归约。

原语可任意组合,覆盖绝大多数DL操作。同时引入Primitive Fusion(基本融合与高级融合)和Fuzzy Matching(聚类树+质心近似),大幅降低表项数量和查找次数。设计目标明确:更高精度、更大规模、更强泛化能力。

5. Pegasus原语(Pegasus Primitives)

Fuzzy Matching:构建聚类树(贪心分裂,最小化SSE),输入向量通过比较快速映射到叶节点质心,实现近似但高效的查找。相比穷举映射,存储效率、查找次数、融合能力和流可扩展性均显著提升(精度损失约1%)。

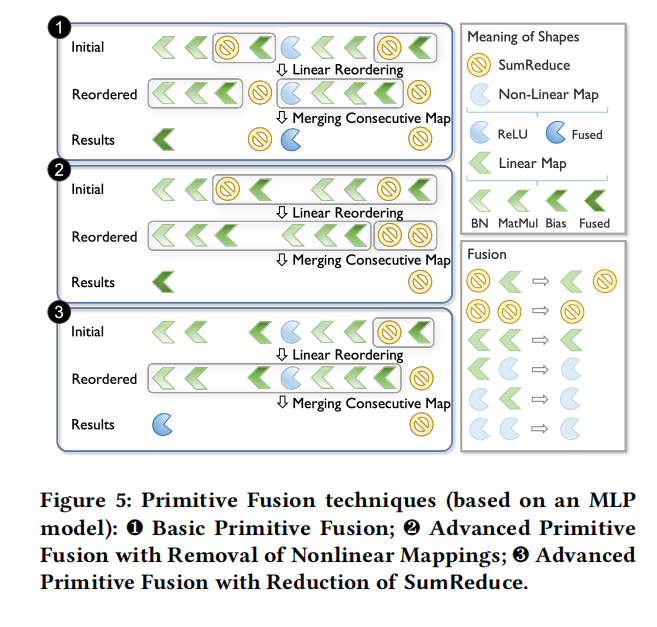

Primitive Fusion:基本融合利用线性重排序和连续Map合并;高级融合通过移除中间非线性映射或保留最终SumReduce,实现单表查找完成多层计算(类似Neural Additive Models)。映射优化还采用反向传播动态调整质心,进一步降低近似误差。

6. 深度学习算子实现(Deep Learning Operators)

论文详细说明如何用三种原语实现常见DL算子:

- Embedding Lookup → Map;

- 元素级变换(BN、ReLU、tanh)→ Map;

- 加权聚合(MatMul、Conv)→ Partition+Map+SumReduce;

- 多输入操作(Softmax、Pooling)→ Map+SumReduce+Map或连续Map。

所有实现均严格遵循数据平面约束,仅依赖比较、查找和加法。

7. 实现(Implementation)

在PISA(Tofino2)上实现时,针对定点聚合、Fuzzy Indexing和阶段限制进行了多项工程优化:13-6-13定点格式防溢出、Consecutive Range Coding(CRC)实现范围匹配、Pegasus Syntax高层抽象+自动翻译工具。

实现了六种代表性模型:MLP-B、RNN-B、CNN-B/M/L、AutoEncoder。其中CNN-L采用Advanced Primitive Fusion,支持3840bit输入和6083Kb模型,仅占用15个流水线阶段。

8. 评估(Evaluation)

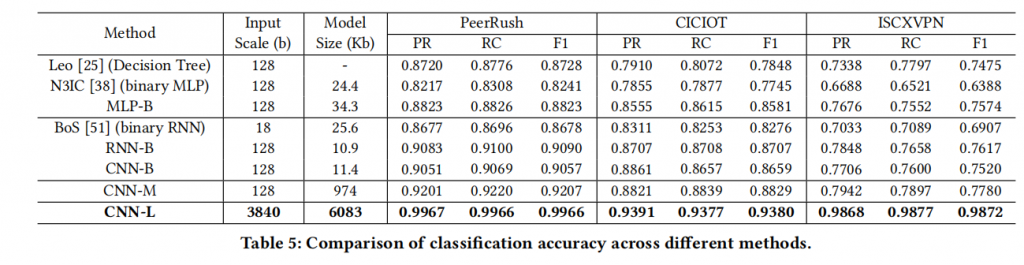

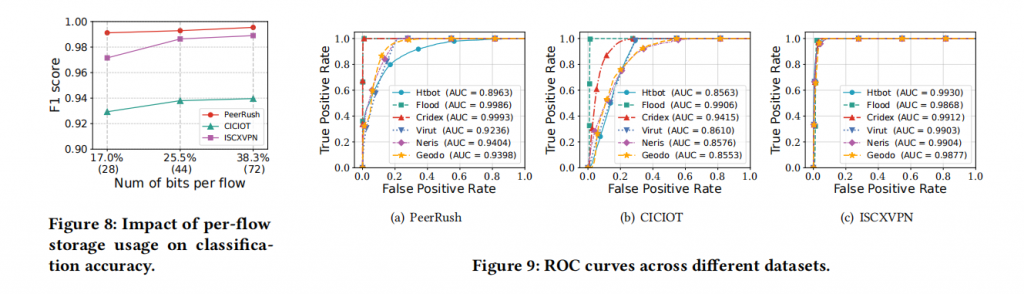

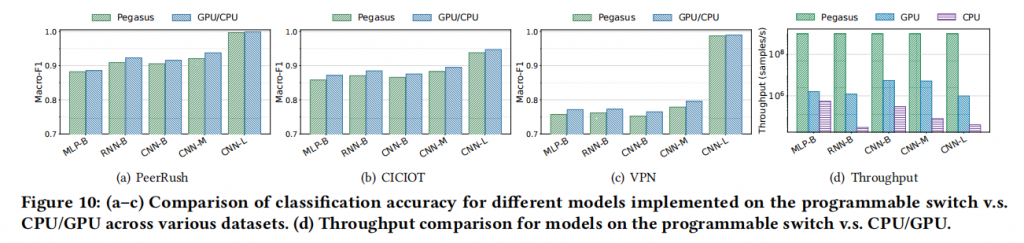

在PeerRush、CICIOT、ISCXVPN三个真实流量分类数据集上:

- 精度:CNN-L较N3IC提升22.8%、较BoS提升17.9%、较Leo提升17.2%;

- 规模:模型大小248×,输入规模212×;

- 资源:CNN-L仅占用7.12% SRAM、13.33% TCAM,支持百万流级别并发;

- 无监督检测:AutoEncoder在未知恶意流量上AUC最高达99.0%;

- 与CPU/GPU对比:精度仅下降约1.08%,吞吐量提升3800×(CPU)和600×(GPU)。

9. 讨论、相关工作与结论(Discussion, Related Work & Conclusion)

讨论了Fuzzy Matching在分布漂移场景下的鲁棒性、与现有IDP工作的互补性,以及未来硬件轻量调整的可能性。相关工作对比显示,Pegasus是首个在商品化交换机上实现多模型、大规模、高精度DL推理的通用框架。

结论指出:限制IDP智能化的不是计算资源,而是MAT抽象的低效使用。Pegasus以简单且实用的原语表达方式,为线速DL推理提供了可行路径,也为未来数据平面持续智能化奠定了基础。