SIGCOMM 2025

1. 课题背景:集体通信调度的瓶颈与挑战

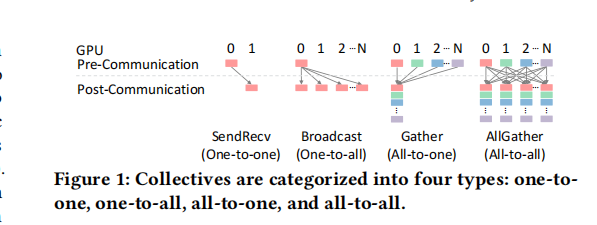

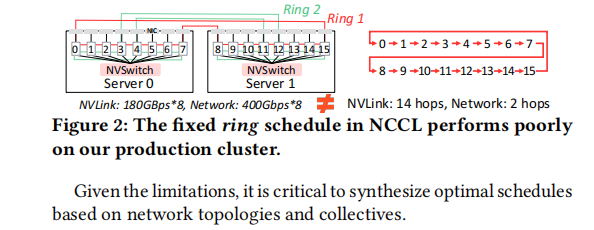

当前,分布式机器学习(如大语言模型训练)的效率受到集体通信(Collective Communication,如 AllReduce、AllGather)的严重制约。随着模型规模从十亿级向万亿级演进,通信耗时在总训练时间中的占比已超过 30%。然而,工业界主流库(如 NVIDIA NCCL)主要依赖预定义的、固定的拓扑算法(如 Ring 和 Tree)。这些固定算法在面对异构带宽、非对称网络拓扑或特定的模型算子需求时,往往无法榨干硬件的峰值性能,导致昂贵的 H800 或 A100 集群出现显著的算力浪费。

现有的自动化调度合成器(如 TACCL、TECCL)尝试通过混合整数线性规划(MILP)来寻求最优解。但这些方案面临严峻的“维度灾难”:随着 GPU 节点数量的增加,搜索空间呈指数级爆炸。对于一个拥有 128 个 GPU 的集群,传统合成器往往需要耗费数天甚至数周才能算出一个次优解,这在瞬息万变的生产环境中是无法接受的。因此,如何在分钟级时间内为大规模集群合成高效调度方案,成为了学术界和工业界共同面临的深层科学问题。

2. 核心技术:基于对称性(Symmetry)的解构与合成

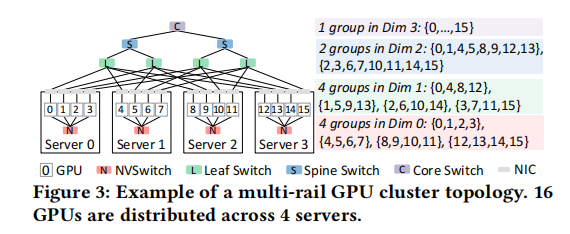

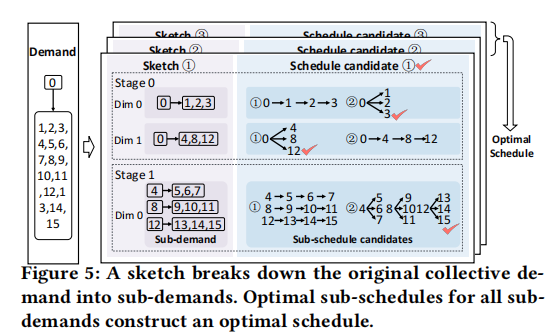

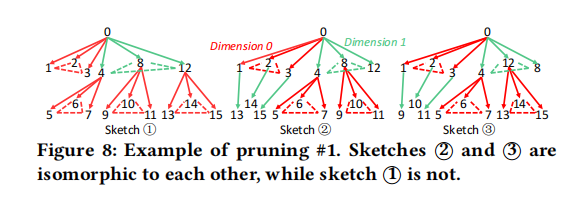

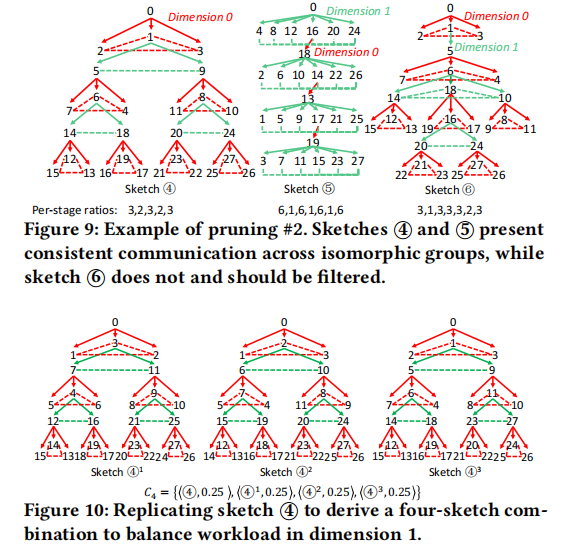

SYCCL 的核心贡献在于其对“对称性”的深刻洞察。研究团队发现,现代数据中心网络(如 Clos 或 Multi-rail 拓扑)以及集体通信算子(如 AllGather)本身具备极强的结构对称性。SYCCL 并没有试图去解决一个庞大的全局优化问题,而是提出了一种基于“草图(Sketch)”的分解机制。它将原始的大规模通信需求拆分为多个规模较小、在拓扑上具有对称关系的子需求。通过只对一个代表性的拓扑子集进行求解,并将所得方案镜像映射到其他对称部分,SYCCL 极大地缩减了求解难度。

在具体的算法实现上,SYCCL 引入了两阶段搜索策略。第一阶段通过粗粒度的时间片划分进行“草图”筛选,快速定位具有高性能潜力的通信路径组合。第二阶段则针对选定的草图进行细粒度的 MILP 优化,精确校准每个数据块的传输时刻和路径。此外,SYCCL 还配备了高效的同构检测引擎,能够自动识别拓扑中冗余的计算路径,确保求解器仅在非冗余的空间内工作。这种“分而治之”的思想,使得 SYCCL 能够将调度合成的时间从数小时缩短至几分钟。

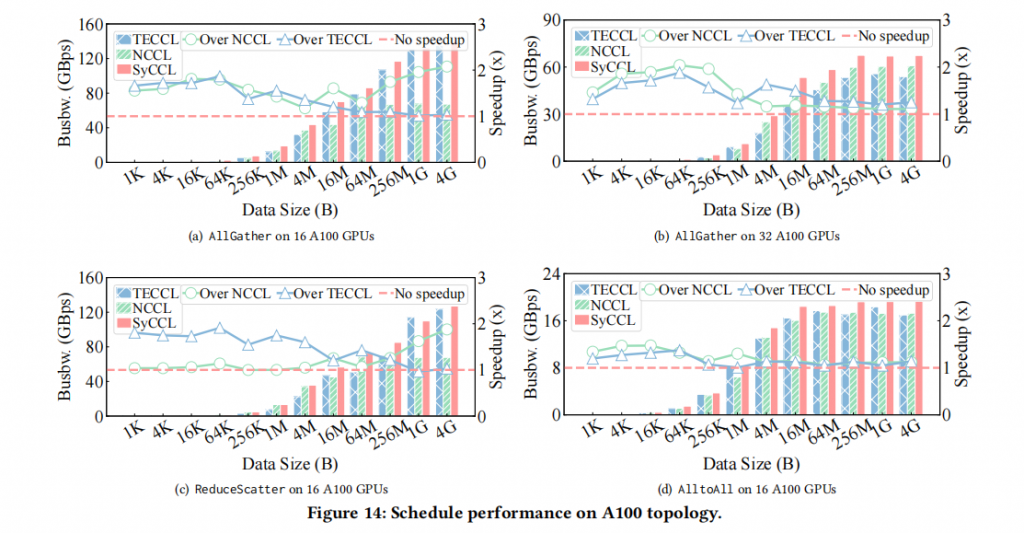

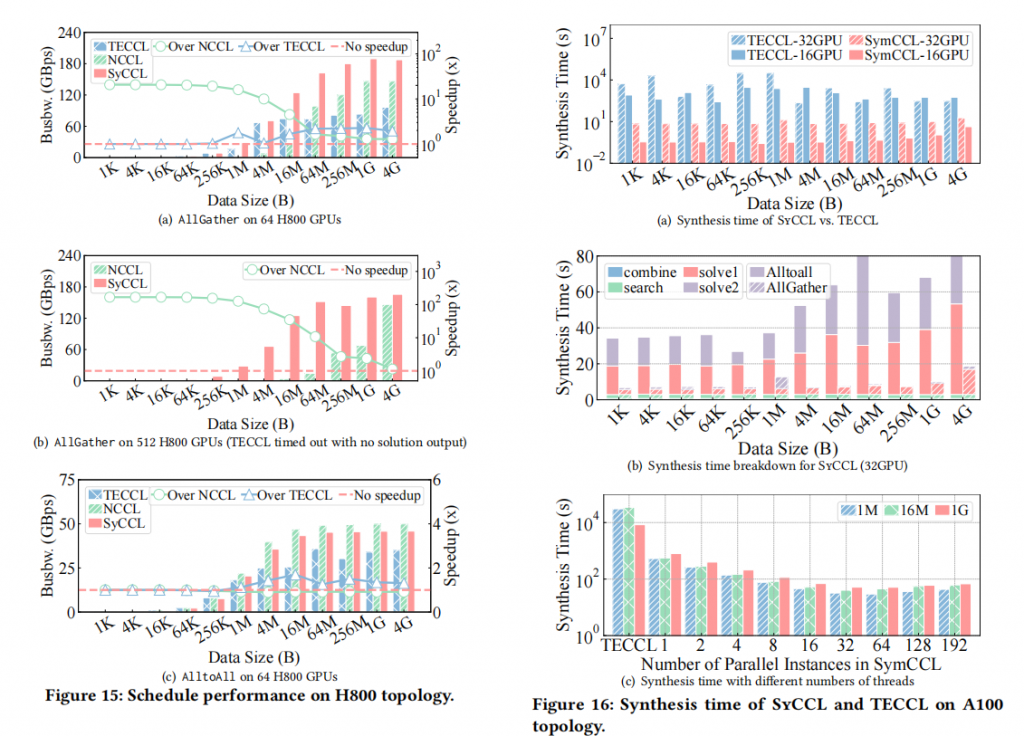

3. 实验验证:性能提升与扩展性分析

在 32 台 A100 服务器组成的测试床以及基于生产规模的仿真实验中,SYCCL 展示了压倒性的性能优势。相比于业界标杆 NCCL,SYCCL 在特定的集体通信任务中实现了高达 127% 的吞吐量提升。在端到端的大模型训练测试中(如 GPT-6.7B 模型),SYCCL 通过优化底层的通信调度,直接为整体训练速度带来了约 6.3% 的提升。这不仅意味着训练时间的缩短,更意味着在同等算力投入下能支撑更大规模的业务迭代。

更令人印象深刻的是其合成效率的质变。在处理 128 个 GPU 规模的 AllGather 任务时,传统合成器 TECCL 因内存溢出或超时而失败,而 SYCCL 仅需不到 10 分钟即可完成高质量方案的生成。在 H800 这一类对带宽极其敏感的拓扑结构中,SYCCL 能够通过手动和自动结合的草图设计,完美适配其特有的带宽比例,有效解决了由于 NVLink 和 PCIe 带宽不平衡带来的通信瓶颈。

4. 结论与未来演进建议

SYCCL 为大规模并行计算中的通信优化开辟了新的范式。它证明了在极复杂的组合优化问题中,利用先验的结构对称性信息可以产生数量级的效率提升。SYCCL 的输出结果采用了 XML 格式,能够与现有的 MSCCL-executor 等执行后端无缝集成,这意味着该系统具备极强的工业落地潜力,可以作为大模型训练底座中“通信引擎”的核心组件。

未来的研究方向可以集中在以下两点:一是将 SYCCL 扩展到更加复杂的非对称故障场景(如部分链路损坏时的动态调度),增强系统的容错性和鲁棒性;二是探索将人工智能技术(如强化学习)与 SYCCL 的草图搜索机制相结合,通过学习历史最优调度经验来进一步加速搜索过程。此外,随着 CXL 等新型互连技术的出现,如何定义新的对称性原语以支持内存池化架构下的通信调度,也将是一个值得深入探讨的课题。