① 研究背景

在多智能体系统(Multi-Agent Systems, MAS)中,如何实现高效协同一直是核心问题。从自动驾驶车队到分布式网络控制,再到你正在研究的跨域协同场景,本质上都面临一个共同挑战:多个异构智能体如何在复杂环境中做出协调一致的决策。

然而现实世界中的多智能体系统往往具有高度异构性——不同智能体拥有不同能力、观测空间和决策机制,这使得传统强化学习方法难以直接建模。此外,随着系统规模扩大,智能体之间的交互关系呈现出动态性和不确定性,进一步加剧了学习难度。更关键的是,现有方法大多依赖“全量信息交互”或“固定拓扑建模”,忽略了一个重要事实:并不是所有信息都同样重要。

受到人类认知机制的启发,在复杂协同过程中,人类会有选择性注意(attention),那么智能体是否也可以“只关注关键交互”?这正是本文的出发点。

② 传统方法的弊端

现有多智能体强化学习(MARL)方法大致可以分为两类:一类是基于集中训练与分布执行(CTDE)的框架,另一类是基于图结构建模的协同方法(如GNN-based MARL)。虽然这些方法在一定程度上提升了协同能力,但仍存在明显局限。

首先,传统图结构方法通常假设智能体之间的关系是静态或规则驱动的,难以刻画真实环境中不断变化的交互模式。这种“固定拓扑”建模方式在异构场景下尤为受限,无法反映不同智能体之间的差异性依赖关系。

其次,大多数方法默认所有邻居信息同等重要,缺乏有效的“信息筛选机制”。这不仅带来了计算冗余,还可能引入噪声干扰,降低决策质量。特别是在大规模系统中,这种“信息过载”问题会严重影响学习效率。

更重要的是,现有注意力机制大多是数据驱动的隐式学习,缺乏可解释性和先验引导,导致模型难以对“为什么关注某些智能体”给出合理解释,也难以融入人类经验知识。

③ Fuzzy Human Attention-Guided Graph(核心方法)

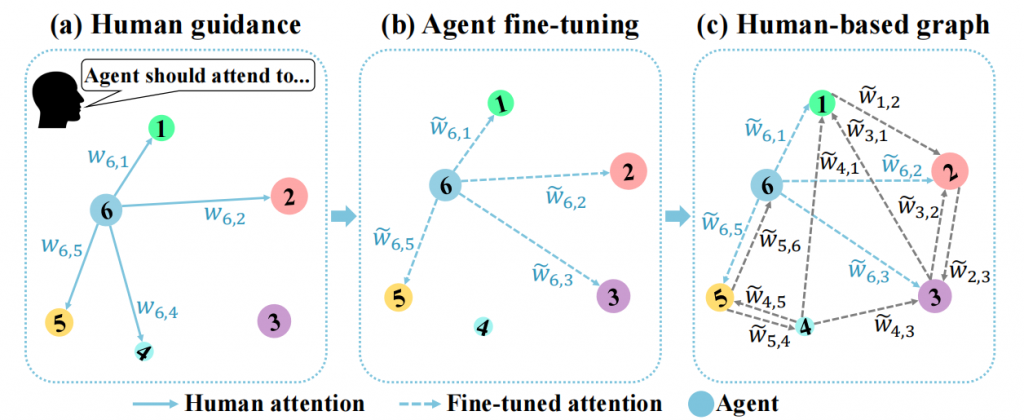

针对上述问题,论文提出了一种全新的框架:Fuzzy Human Attention-Guided Graph Reinforcement Learning(FHAG-RL),其核心思想是——将人类模糊注意力机制引入多智能体图结构建模中。

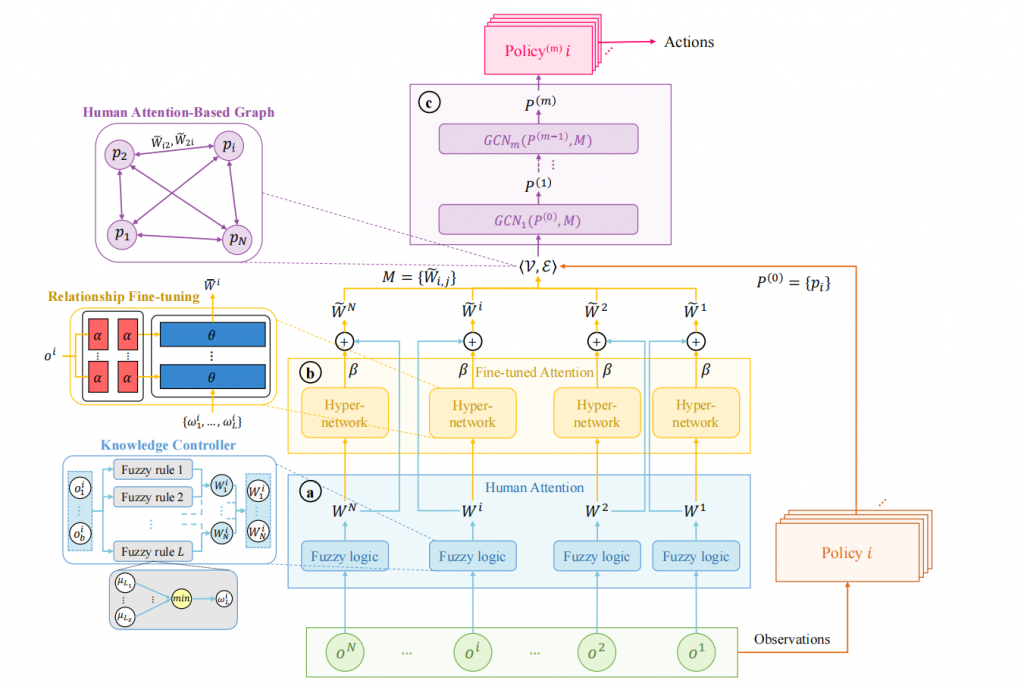

具体而言,作者构建了一种“模糊注意力引导图”(Fuzzy Attention Graph),通过模糊逻辑(Fuzzy Logic)来刻画智能体之间的关系强度。这种方式不同于传统硬连接(0/1边),而是赋予每条边一个连续的“注意力权重”,从而实现更细粒度的交互建模。

更进一步,该方法将人类经验知识编码为模糊规则,例如“距离越近,影响越大”“状态越相关,关注度越高”等,通过模糊推理系统动态生成注意力权重。这种机制使得图结构不再完全依赖数据学习,而是融合了先验知识+数据驱动的双重优势。

在强化学习层面,模型结合图神经网络(GNN)进行信息聚合,并通过策略梯度或值函数方法进行优化,实现从“感知—注意—决策”的闭环学习过程。最终,每个智能体能够在局部观测下,通过选择性关注关键邻居,实现更高效的协同决策。

从本质上看,这一方法完成了一次重要转变:

👉 从“全量交互” → “选择性交互”

👉 从“隐式注意力” → “可解释注意力”

👉 从“纯数据驱动” → “人机知识融合驱动”

④ 实验结果

在实验部分,作者在多个典型多智能体任务中验证了方法的有效性,包括协同控制、资源分配以及复杂动态环境中的决策任务。

实验结果表明,相比于传统MARL方法(如MADDPG、MAPPO以及GNN-based方法),FHAG-RL在多个指标上均取得显著提升。首先,在收敛速度方面,该方法能够更快学习到有效策略,说明模糊注意力机制有助于降低搜索空间复杂度。

其次,在最终性能表现上,FHAG-RL在任务成功率、累计奖励等指标上均优于基线方法,尤其是在高异构性场景下优势更加明显。这表明其对不同类型智能体之间关系建模更加准确。

此外,在泛化能力方面,该方法在未见过的环境配置中仍能保持稳定表现,说明引入人类先验知识有助于提升模型的鲁棒性。值得注意的是,论文还通过可视化分析展示了注意力权重分布,验证了模型确实学会“关注关键智能体”,增强了方法的可解释性。

⑤ 总结

总体来看,这篇论文的最大亮点在于将人类模糊认知机制引入多智能体强化学习框架中,构建了一种兼具表达能力与可解释性的图结构建模方法。通过“模糊注意力+图强化学习”的融合,成功缓解了异构多智能体系统中的信息冗余与交互建模难题。