SIGCOMM ’25: ACM SIGCOMM 2025 Conference September 8 – 11, 2025 Coimbra, Portugal

1. 摘要与研究背景:云网络运维的瓶颈与大模型的机遇

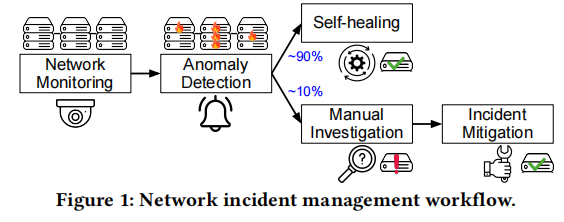

在现代超大规模公有云基础设施中,如阿里巴巴云,维护网络的高可用性是至关重要且极具挑战的任务。每当网络发生故障(即“事件”)时,运维人员(Operators)必须在极短的时间内从海量的监测数据中识别出根因设备(Error Device)。传统的自动化运维工具(AIOps)虽然在处理常见故障时表现良好,但面对复杂或从未见过的故障时,往往缺乏逻辑推理能力和泛化性,导致人工介入成为必然 。然而,人工调查过程极其繁重且耗时,由于单次故障可能触发成百上千个设备产生GB级别的警报日志,运维人员往往在无法查阅完所有日志的情况下就需要做出决策,这种信息过载与处理能力限制之间的矛盾,使得故障定位成为了整个运维工作流中的主要瓶颈 。

大语言模型(LLM)的兴起为解决这一困境带来了曙光。LLM在文本理解和逻辑推理方面展现出的卓越能力,使其非常适合处理监测系统生成的文本化警报信息 。与人类相比,模型不会受到疲劳或压力的影响,能够高效、一致地阅读和分析大规模数据 。在此背景下,论文提出了名为 BIAN 的框架,旨在将LLM作为运维人员的“智能助手”,通过深入理解网络监测日志、拓扑结构和时间线数据,自动生成故障设备排名及详细的解释性报告,从而显著提升故障定位的效率和准确性 。BIAN不仅是一个理论模型,更是一个已在阿里巴巴全球基础设施中实际部署超过10个月的实用系统 。

2. 核心架构设计:分层推理与多维数据集成

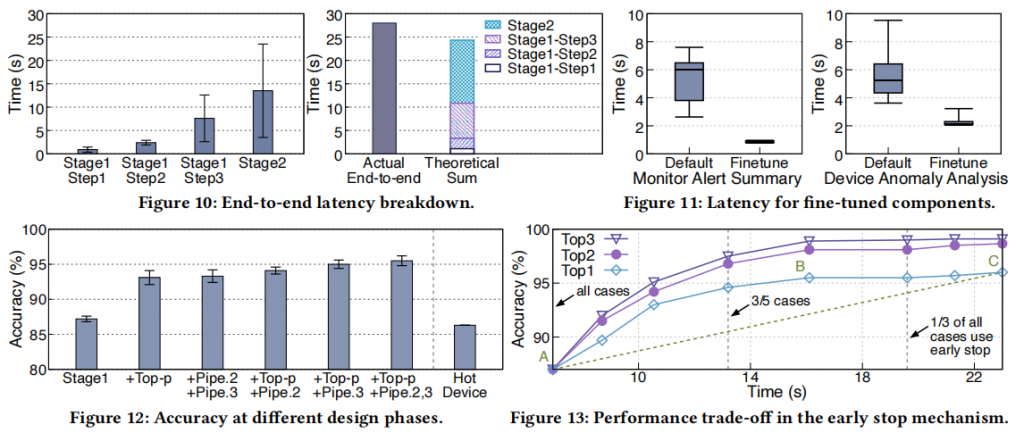

为了应对生产规模网络中数据量庞大且关系复杂的挑战,BIAN采用了精妙的分层推理(Hierarchical Reasoning)架构。由于LLM难以一次性处理并提取海量原始日志中的关键信息,BIAN将定位任务分解为三个步骤:首先是警报摘要,将冗长的监测警报简化为易于理解的摘要报告;其次是设备级异常分析,按设备对报告进行分组,并遵循运维人员多年积累的标准作业程序(SOP)进行深入分析;最后是故障评分,综合所有单设备的分析结果,为候选设备计算嫌疑分值 。这种分而治之的策略不仅降低了模型的认知负荷,还使得推理过程具有极高的可解释性,方便运维人员快速核对模型给出的依据 。

此外,为了解决网络故障在时空维度上的复杂性,BIAN集成了多维数据管道。在大型网络中,单一设备的故障可能引发连锁反应,导致逻辑上相近的一系列设备在不同时间点报错 。BIAN除了处理原始警报日志外,还引入了网络拓扑结构和事件时间线两个维度的信息 。通过整合这三条管道的数据,BIAN能够执行更全面的推理:它不仅关注某个设备是否报错,还分析报错的时序关系以及故障在拓扑上的传播路径 。例如,当多个设备同时报警时,BIAN能通过拓扑信息识别出谁处于流量的关键上游,从而精准锁定真正的故障源,这种多维集成显著提升了系统处理复杂关联故障的能力 。

3. 系统的持续进化:知识自动更新与性能优化

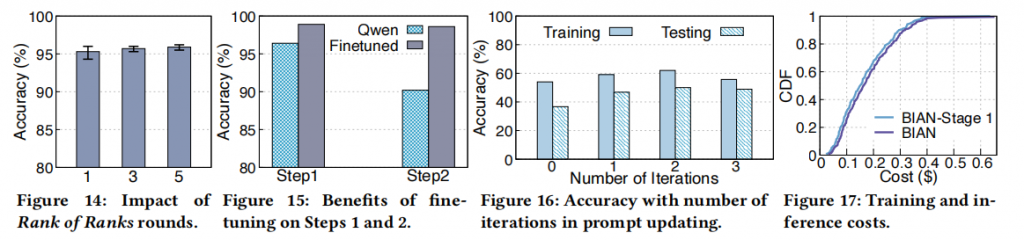

网络基础设施及其配置始终处于快速演变中,这意味着固定的推理逻辑会迅速失效。BIAN设计了一套创新的**持续提示词更新(Continuous Prompt Updating)**机制,使其能够像人类运维人员一样从经验中学习 。该机制并不改变模型参数,而是利用LLM自身的生成、反思和总结能力,自动从历史故障案例中提取新的知识 。具体而言,系统会对比正确和错误的推理尝试,识别出影响结果的关键因素,并将这些经过验证的经验整合进任务提示词(Prompts)中 。这种“训练提示词而非训练参数”的方法,既保证了系统的敏捷性,又避免了大规模微调模型带来的昂贵计算开销和黑盒化问题 。

在实际生产部署中,效率和资源消耗是必须考虑的因素。为此,BIAN实施了多项系统级优化方案。首先,它使用了经过领域知识微调的小规模LLM来处理简单的摘要和单设备分析任务,在保证精度的同时大幅降低了推理延迟 。其次,引入了早停机制(Early Stop):如果第一阶段的分析结果已经展现出极高的置信度,系统将提前结束后续复杂推理,以节省资源 。此外,为了对抗LLM输出的随机性,BIAN采用了**“排名之排名”(Rank of Ranks)**技术,通过多次重复运行推理并计算平均排名,平滑掉偶发的逻辑偏差,确保输出结果的稳定性和可靠性 。

4. 实验评估与实战

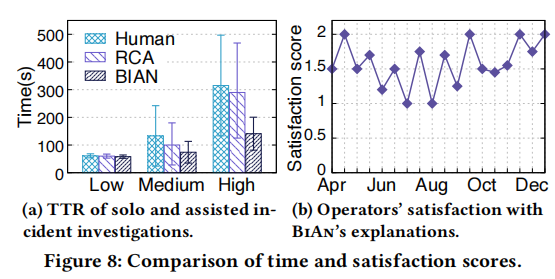

论文通过对长达17个月的历史真实案例进行离线评估,并结合在阿里巴巴云的实际运行数据,全面验证了BIAN的卓越性能。实验结果显示,BIAN在故障定位的准确率上比传统基准方法提高了9.2% 。在处理速度方面,整个推理过程通常在30秒内即可完成 。这意味着在运维人员收到警报并登录系统的一分钟内,BIAN的详细分析报告就已经准备就绪,实现了真正的“即时辅助” 。通过A/B测试发现,BIAN使故障定位的平均时间(TTR)缩短了20.5%,而对于影响重大的高风险事件,效率提升更是高达55.2% 。

除了硬性的指标提升,BIAN在真实生产环境中的用户体验也得到了高度评价。新入职的运维人员反馈,BIAN提供的带有详细依据的设备排名极大降低了他们的上手难度,使其只需最少的培训即可开展工作 。资深运维人员则认为,BIAN生成的解释性报告能够帮助他们快速验证直觉,尤其是在多设备并发警报的混乱场景下,BIAN能有效地协助他们拨开云雾锁定真凶 。尽管BIAN目前在处理罕见的多设备共同故障及链路相关故障方面仍有局限性,但其作为生产级LLM运维系统的成功实践,为AIOps领域迈向更高阶段的智能化提供了极具价值的范本 。

5. 总结与启示

总的来说,BIAN 的成功研制与部署不仅是阿里巴巴在 AIOps 领域的一次重大技术突破,更是大语言模型(LLM)从“通用对话工具”向“垂直行业专家”转化的成功典范。论文通过详实的生产环境数据证明,LLM 并不只是一个简单的信息检索器,通过合理的分层架构设计(分层推理、多维数据集成、持续知识更新),它能够像资深运维专家一样,在复杂的网络拓扑和海量的警报数据中抽丝剥茧,精准锁定故障根因。BIAN 的出现,有效地解决了传统自动化工具在处理复杂、长尾故障时表现疲软的痛点,将原本高度依赖人工经验的排障过程转化为一种可扩展、可解释且持续进化的机器智能流程。

展望未来,BIAN 所代表的“LLM-Agent 驱动运维”模式,为实现真正意义上的“自愈网络(Self-healing Networks)”奠定了坚实基础。虽然目前该系统在处理多设备并发故障和链路级问题上仍有提升空间,但它已经开启了一个全新的范式:即通过小规模模型执行高频、基础的分析任务,辅以闭环的知识更新机制,构建起一套能够自我迭代的智能运维大脑。这不仅极大地释放了人力资源,降低了大规模云基础设施的维护成本,也为其他高可靠性要求的工业系统(如智能制造、能源管理等)提供了极具参考价值的智能化转型路径。BIAN 的实践告诉我们,当领域专业知识与大模型的通用推理能力深度融合时,工业生产的效率将迎来质的飞跃。