① 研究背景

连续时间神经网络近年来逐渐成为深度学习中的重要研究方向。这类模型通常通过微分方程(Differential Equations)描述神经网络状态随时间的动态演化,能够在连续时间域上建模复杂系统,因此在时序建模、物理系统模拟以及不规则时间序列处理等任务中表现出良好的潜力。例如,基于常微分方程(ODE)的神经网络模型能够将传统神经网络中的网络深度维度和RNN中的时间维度统一为连续向量场,从而实现参数共享、自适应计算以及对非均匀采样数据的建模能力。然而,这类模型在实际应用中存在一个关键瓶颈:连续时间神经网络通常依赖数值微分方程求解器进行计算。这种依赖导致了两个重要问题:模型训练和推理速度严重受限;难以扩展到更复杂、更大规模的任务。因此,一个自然的问题是:是否能够绕开数值ODE求解器,直接得到神经网络动力学的解析表达?

② 传统方法的弊端

当前连续时间神经网络的核心计算方式是通过数值积分求解ODE。在这种框架下,模型每一次前向传播都需要调用数值求解器。这些方法会带来几个明显的问题:

- 计算复杂度高:数值ODE求解器需要大量时间步迭代,当模型复杂或精度要求提高时,求解器需要更多步长,从而导致计算成本迅速增加。

- 数值误差不可避免:数值求解器本质是近似计算,因此误差会随着步长累积这会带来稳定性问题,特别是在长时间序列建模中。

- 训练和推理效率低:当任务复杂度增加(例如自动驾驶、医疗时间序列、金融数据)时,这个问题会变得更加严重。

③ Closed-form Continuous-time Neural Networks(CfC)

为了解决ODE求解器带来的计算瓶颈,论文提出了一种新的神经网络架构:直接构造连续时间神经网络的闭式解(closed-form solution)。

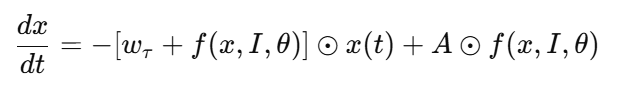

从 Liquid Time-Constant Networks (LTC) 出发分析神经元动力学。LTC的隐藏状态满足如下微分方程:

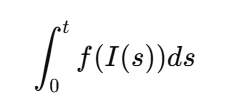

这个方程本质上描述了神经元与突触之间的连续时间动力学。但这个方程在一般情况下没有解析解。作者提出了一种新的近似方法,对积分项:

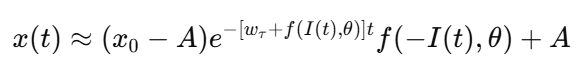

进行分析,并构造紧致近似,最终得到闭式表达。最终得到神经元状态近似解:

这个表达式最大的优势是时间变量直接出现在闭式表达式中。因此模型不再需要ODE求解器,并且可以可以直接计算状态,

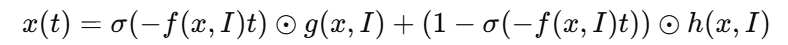

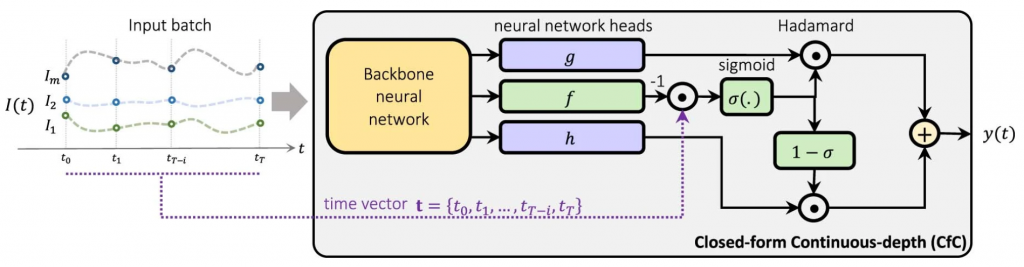

在此基础上,作者设计了新的神经网络结构:

这个结构可以理解为一个连续时间的门控网络(continuous-time gating)。这种设计让模型保留连续时间特性,同时具备RNN的计算效率。

④ 实验结果

论文在多个连续时间序列建模任务上对 CfC 模型进行了系统评估,包括人体行为识别、事件序列 MNIST、不规则时间序列建模以及自动驾驶控制等任务。实验结果表明,在保持甚至提升预测性能的同时,CfC 在计算效率上相较传统基于微分方程的模型实现了显著提升。作者指出,由于模型不再依赖数值微分方程求解器,其训练与推理速度相比 Neural ODE、LTC 等连续时间模型能够提升 1–5 个数量级,从而大幅降低计算开销。在人体行为识别数据集上,CfC 模型取得了 87.04% 的准确率,并且训练时间显著短于ODE模型;在 irregular MNIST 任务中,CfC 结构达到 98.09% 的识别准确率,同时推理效率比传统连续时间网络提升 数倍。此外,论文还在自动驾驶控制任务中进行了真实系统验证,模型在仅使用约 4000 个循环神经网络参数的情况下即可稳定完成车道保持任务,并表现出良好的鲁棒性。整体实验结果表明,Closed-form Continuous-time Neural Networks 在保持连续时间建模能力的同时,成功摆脱了数值ODE求解器带来的计算瓶颈,实现了更快、更稳定且更具可扩展性的时序建模能力。

⑤ 总结

这篇论文提出了一种非常具有启发性的思路:将连续时间神经网络从“数值求解问题”转变为“闭式表达问题”。核心贡献可以总结为三点:

- 提出连续时间神经网络的近似闭式解方法解决通过数值积分求解ODE计算复杂度高和数值误差的问题

- 构建 Closed-form Continuous-time Neural Networks (CfC) 架构

- 在多种时序任务上实现 更高效率与更好性能