1. 摘要(Abstract)

本文聚焦于 LLM-based Search Agent 的训练问题。现有方法在强化学习训练中主要面临一个核心难点credit assignment(贡献归因)。一方面,基于最终答案的 outcome supervision 虽然训练稳定,但奖励信号过于稀疏,无法区分不同搜索轮次的重要性。另一方面,基于中间步骤的 process supervision 虽能提供更细粒度信号,但通常依赖不稳定的价值估计或噪声较大的中间奖励,容易导致训练不稳。

针对这一问题,论文提出 Contribution-Weighted GRPO(CW-GRPO)。该方法在保留 GRPO 稳定性的基础上,引入一个 LLM judge 对每一轮搜索进行评估,从“检索是否有效”和“推理是否正确”两个维度生成贡献信号,并据此对整条轨迹的优势进行重分配。不同于直接优化过程奖励,CW-GRPO 将过程信息用于调节最终奖励的分布,从而实现更稳定的细粒度 credit assignment。

实验结果表明,该方法在多个知识密集型问答任务上均优于现有方法,在 Qwen3-8B 上提升 5.0%,在 Qwen3-1.7B 上提升 6.3%。进一步分析发现,成功轨迹中的有效贡献通常集中在少数关键搜索轮次,而非均匀分布。整体来看,该工作不仅提出了一种有效的训练方法,也揭示了搜索型智能体中的重要结构性特征。

2. 研究背景与问题动机(Introduction)

随着大模型能力的发展,仅依赖参数知识已难以满足实时信息和复杂知识任务的需求。引入搜索能力后,模型可以通过多轮检索与推理获取外部信息,从而显著提升事实性和复杂推理能力。因此,search agent 成为当前大模型的重要发展方向。

然而,多轮搜索也带来了新的训练难点。一个典型问题是模型最终答对,并不意味着每一轮搜索都同样重要。有些轮次提供了关键证据,有些只是重复或无效尝试。但现有方法往往无法区分这些差异。

当前主流方法主要有两类:

* Outcome supervision只依据最终答案打分,稳定但过于粗粒度

* Process supervision对中间步骤打分,但依赖额外模型或噪声较大

两者分别在“稳定性”和“精细度”之间存在明显权衡。

因此,论文的核心动机是能否在不破坏训练稳定性的前提下,引入中间过程信息,实现更合理的 credit assignment?

CW-GRPO 的提出,正是对这一问题的直接回应。

3. 系统框架与整体设计(Framework Overview)

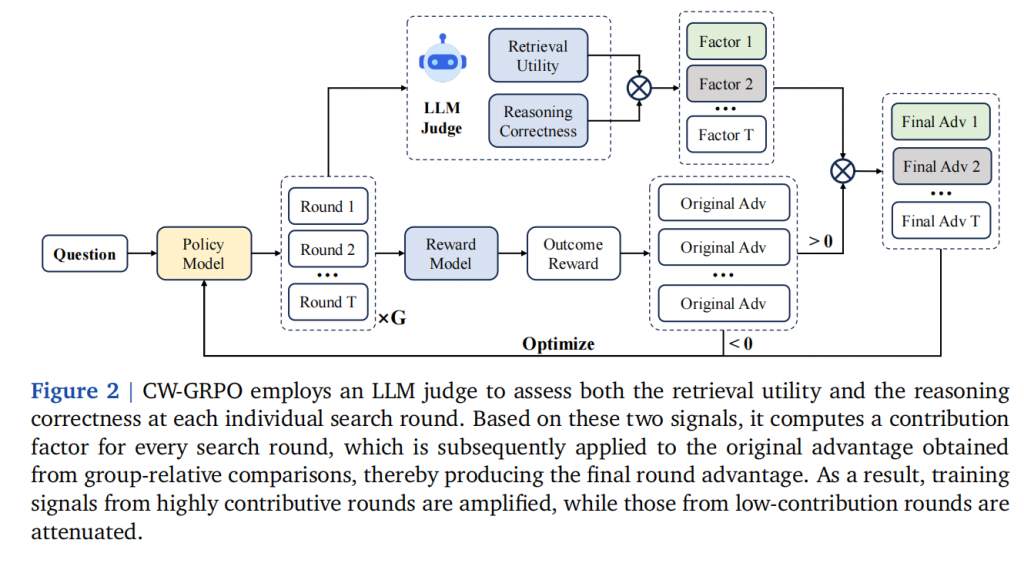

CW-GRPO 的整体结构可以理解为三部分:

1. GRPO 主体负责基于最终结果计算轨迹级优势,保证训练稳定

2. LLM Judge 模块对每一轮搜索进行质量评估

3. 优势重分配机制根据轮次贡献重新分配学习信号

具体来说,对于每个问题,模型会采样多条搜索轨迹,并根据最终答案计算 outcome reward。与标准 GRPO 不同,CW-GRPO 会进一步分析轨迹内部结构,将整体优势拆分并重新分配到各个搜索轮次。

这里的关键设计在于LLM judge 并不直接生成训练奖励,而是作为“参考信号”,用于调节优势分布。这种设计有效避免了过程监督中常见的噪声放大问题。

从本质上看,CW-GRPO 并没有改变“哪条轨迹更好”,而是改变了“这条轨迹中哪几步更值得学习”。

4. 核心方法(Core Method)

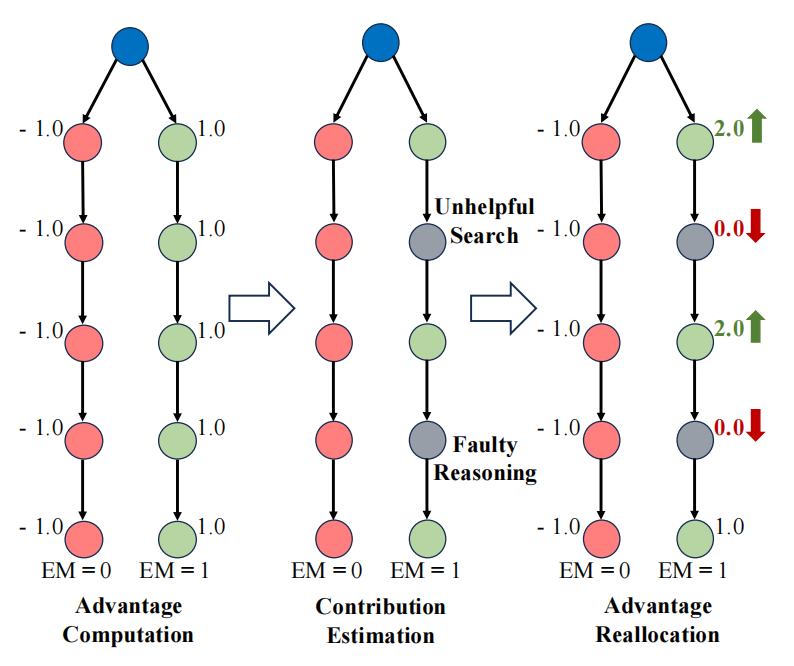

这篇论文的核心方法其实可以拆成四步。第一步,像标准 GRPO 一样,先在同一问题下采样多条轨迹,并根据最终答案对错算出每条轨迹的 outcome-level advantage。这一步做的是“整条轨迹之间谁更好”的比较,它解决的是轨迹级别的优劣问题,但还没有解决轮次级别的 credit assignment。

第二步,作者开始对每一轮搜索做“贡献估计”。这里他们没有用单一分数,而是把轮次质量拆成两个二值信号:一个叫 retrieval utility,看这轮检索到的文档是不是提供了新的、和任务相关的证据。另一个叫 reasoning correctness,看这一轮推理有没有正确理解当前上下文,并沿着合理路径往答案推进。只有这两个条件同时满足,这一轮才会被认为真正“有贡献”。作者采用的是一种很保守的合取式设计,也就是两者同时为 1 才算贡献轮。这背后的逻辑很朴素,只搜到信息但理解错了,不算真贡献。推理本身逻辑通顺但没有带来新信息,也不算真推进。

第三步,是把上面的二值贡献信号转成真正的权重。这里作者对成功轨迹和失败轨迹做了区分。对于成功轨迹,论文认为可以较可靠地识别出哪些轮次对最终成功更关键,因此使用一个由参数 α 控制的 softmax 来强调高贡献轮次。α 越大,学习信号就越集中。当 α = ∞ 时,只有同时满足检索有用且推理正确的轮次,才真正分到优势信号。对于失败轨迹,作者反而很谨慎,没有做细粒度区分,而是统一均匀分配。原因是失败的成因通常很模糊:可能是检索器没召回到关键文档,可能是语料本身没覆盖,可能是中间轮次其实做了合理尝试,只是最后还是没解出来。在这种情况下,硬给失败轨迹每一轮分高低,反而容易把噪声引进来。

第四步,就是 advantage reallocation。作者把轨迹级的 outcome advantage 按照上一步的权重重新分配到每一轮搜索上,而最终回答轮次仍直接使用 outcome advantage。这样,模型在更新时就会更关注那些真正推动成功的搜索轮,而不是把同样的学习强度平均地撒在整条轨迹上。论文特别强调,这种做法不会改变整条轨迹总的学习信号量级,只是重新安排了“信号落在哪些轮次上”。这也是为什么它既能保留 GRPO 的优化稳定性,又能引入更细粒度的过程信息。

另外,作者还专门做了 judge calibration。他们人工标注了 97 个搜索轮次,最终让 LLM judge 与人工判断在 retrieval utility 和 reasoning correctness 上达到约 95% 的一致率,说明这个 judge 至少在他们的设定里不是随便拍脑袋打分,而是做过较认真校准的。这个细节很重要,因为它关系到方法是否可信,如果 judge 本身很不靠谱,后面的优势重分配就站不住。

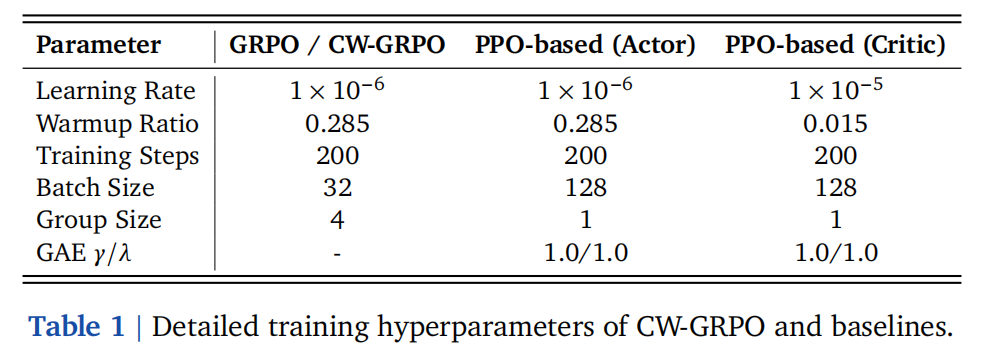

5. 实验设置(Setup)

实验涵盖两类任务

* General QA(NQ、TriviaQA、PopQA)

* Multi-hop QA(HotpotQA、2Wiki、Musique、Bamboogle)

评价指标为 Avg@4 Exact Match(EM)。

值得注意的是,论文采用了更严格的测试设定:

* 使用 hard-case 数据集(大模型也难以解决)

* 禁止模型依赖参数知识,必须通过检索完成任务

模型方面,采用 Qwen3-8B 和 Qwen3-1.7B 作为 backbone,并与多种 RL 方法进行对比。

6. 实验结果与分析(Experiments)

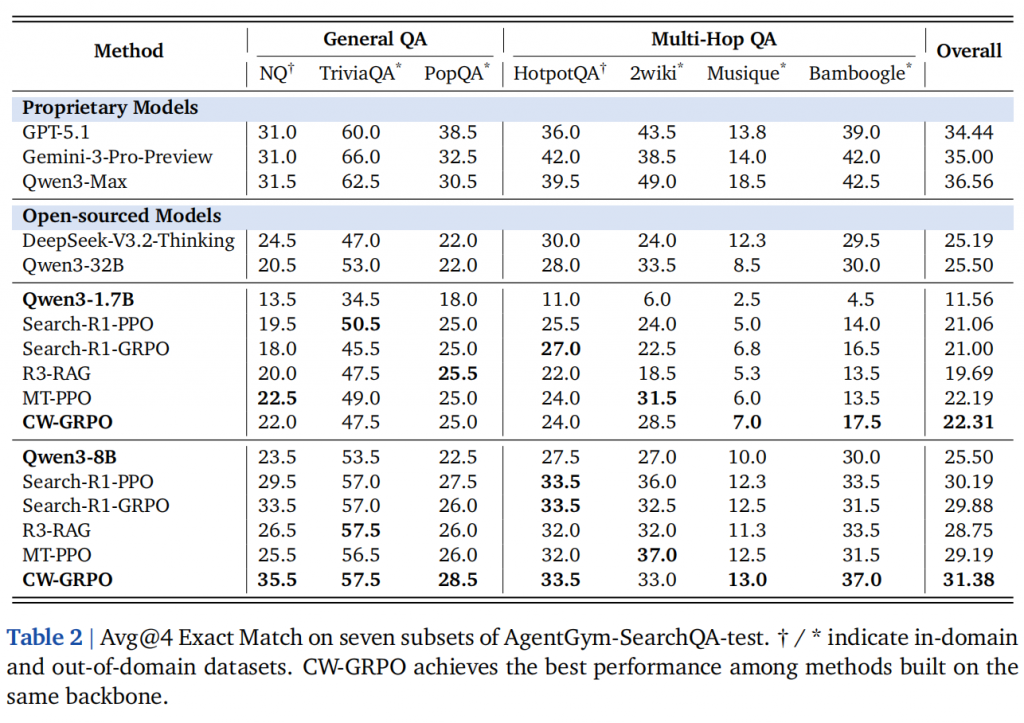

整体结果 CW-GRPO 在所有对比方法中表现最优:

* Qwen3-8B提升 5.0%

* Qwen3-1.7B提升 6.3%

任务表现分析

在 Multi-hop QA 上提升更明显,说明方法在长链推理任务中优势更大。

在简单任务上优势相对有限。

贡献分布分析

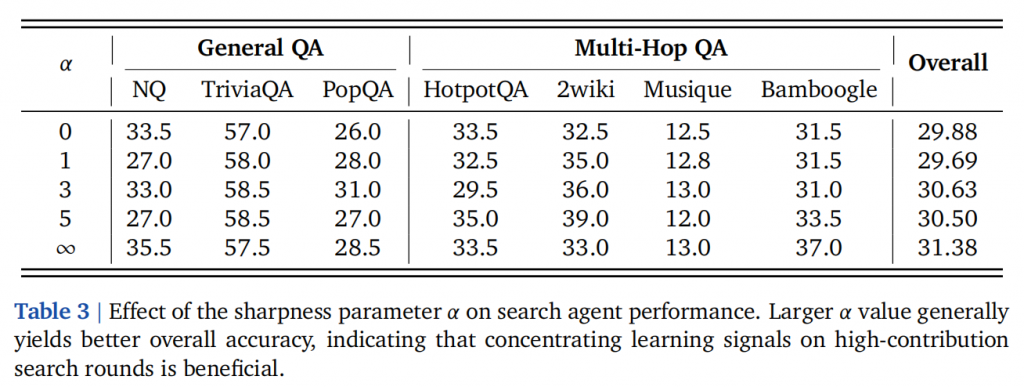

实验表明,随着参数 α 增大,性能提升明显,最优出现在 α=∞。

说明成功轨迹的关键贡献集中在少数轮次,而非平均分布。

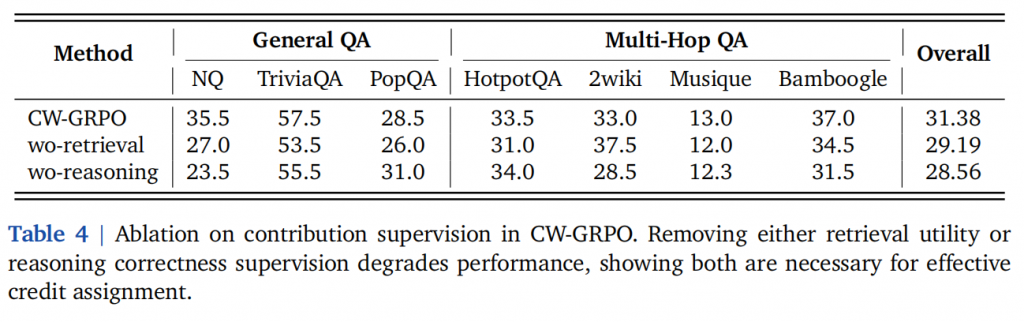

消融实验

去掉任一信号(检索或推理)都会降低性能,说明两者缺一不可。

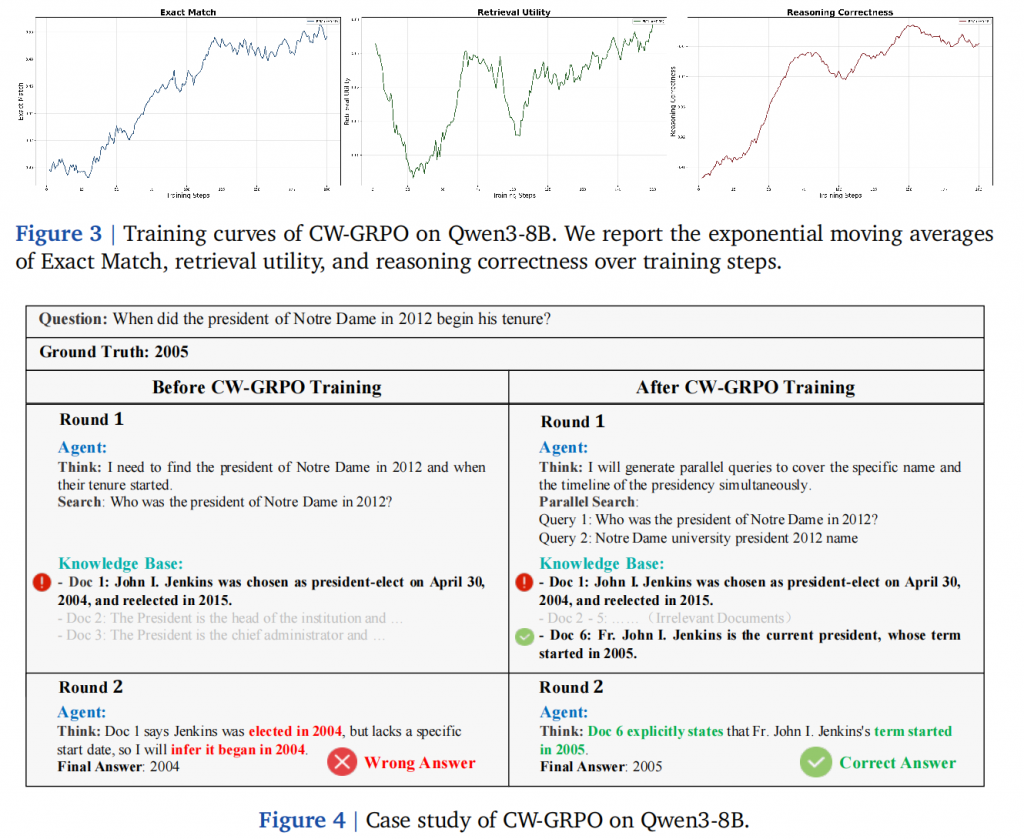

训练稳定性与案例分析

训练曲线稳定提升(Figure 3),说明方法未破坏优化稳定性。

案例分析(Figure 4)显示,模型在训练后能够进行更全面搜索并正确利用证据。

7. 贡献与结论(Conclusion)

本文的主要贡献包括:

(1)提出将 process supervision 重构为优势重分配问题

(2)设计 CW-GRPO,实现稳定且细粒度的 credit assignment

(3)发现搜索任务中“贡献集中”的结构性特征

(4)在多个任务上验证方法有效性

从整体来看,这篇工作真正解决的不是“如何让 agent 更强”,而是一个更基础的问题,在多轮搜索中,成功究竟来源于哪几步,以及训练信号应该如何分配。CW-GRPO 给出的答案:不是增加奖励,而是重新分配奖励。这一思路在保证稳定性的同时,引入了过程信息,对后续搜索型智能体的训练具有较强参考价值。