SIGCOMM ’25: ACM SIGCOMM 2025 Conference September 8 – 11, 2025 Coimbra, Portugal

研究背景与超大规模网络管理的痛点

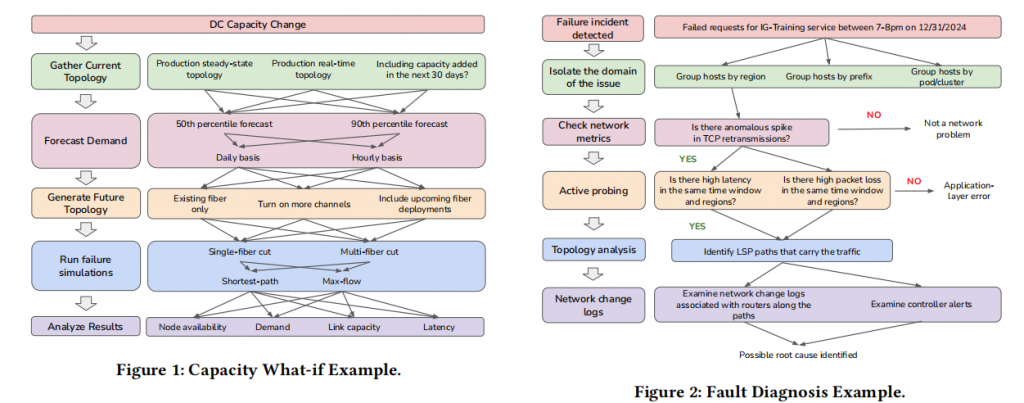

在现代互联网基础设施中,超大规模网络(Hyper-scale networks)的管理是一项极具挑战性的任务,涉及流量工程、设备配置和故障自动诊断等多个复杂领域 。Meta 在文中指出,尽管大语言模型(LLM)展现出了强大的潜力,但在生产环境中直接应用面临三大痛点:首先,任务复杂度极高,往往需要跨越多个步骤,单步 LLM 难以直接生成可靠结果 ;其次,工具链高度碎片化,Meta 内部拥有数百个专用的 API 和工具,掌握这些工具的输入规范需要深厚的领域知识 ;最后,网络操作对安全性和准确性有近乎苛刻的要求,任何由 LLM 幻觉引起的配置错误都可能导致大规模服务中断 。

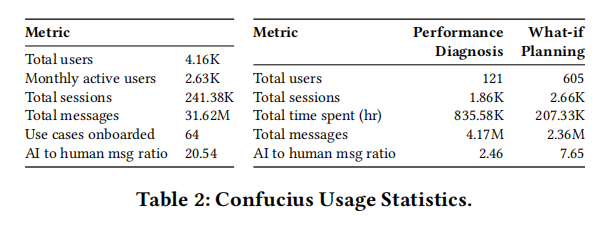

为了应对这些挑战,Meta 开发了 Confucius(孔子) 框架 。该框架的核心思路不再是让一个大模型完成所有工作,而是通过“多智能体协作”将复杂的管理意图拆解为一系列可执行的子任务 。这种方法不仅能降低单个模型的推理压力,还能更好地集成现有的专家经验和成熟的工具链 。在过去的两年里,Confucius 已支持了超过 60 个生产级应用,涵盖了从拓扑设计到容量规划再到故障诊断的全生命周期 。

Confucius 核心架构与多智能体协同逻辑

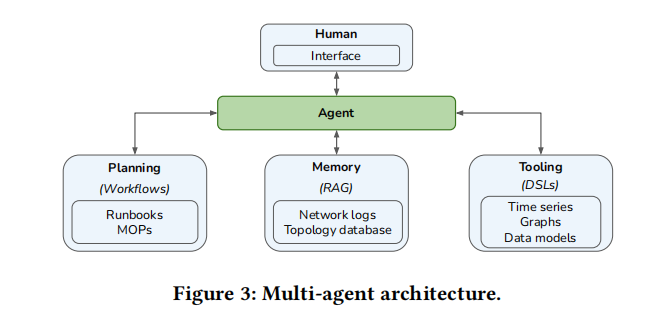

Confucius 的架构设计采用了“分而治之”的策略。其最核心的创新是将网络管理工作流建模为 有向无环图(DAG) 。当用户输入自然语言意图(例如:“分析如果某条光缆中断对 backbone 的影响”)时,规划智能体(Planning Agent)会将此意图分解为一系列逻辑节点,每个节点代表一个具体的子任务,如提取当前拓扑、预测流量波动、运行模拟器等 。通过 DAG 结构,系统可以清晰地定义任务间的依赖关系,支持并行执行和中途的人工干预 。

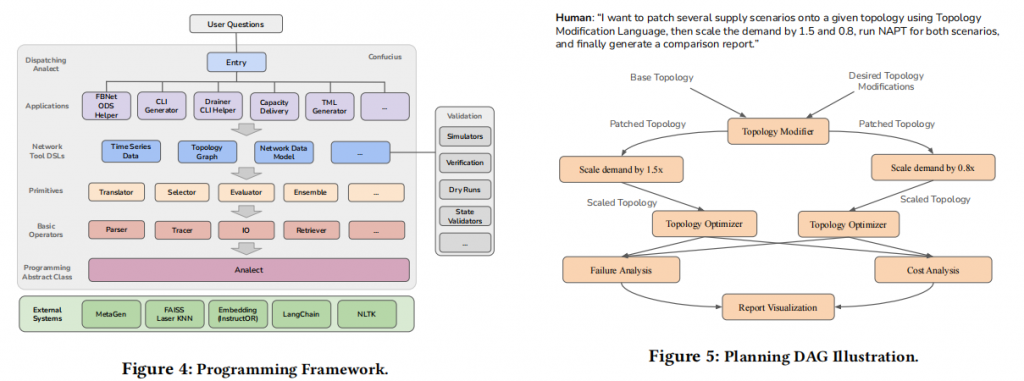

为了实现高度的抽象与复用,Confucius 引入了名为 Analect(论语单元) 的轻量级包装器 。每个 Analect 都是一个强类型的执行单元,具有定义的输入输出模式(基于 Pydantic)和具体的执行逻辑 。这种设计使得开发者可以像搭积木一样,快速将现有的 Python 服务或 API 封装为 LLM 可调用的技能。此外,系统还设计了 Ensemble(集成)机制,通过结合多个不同基础模型(如 Llama、Claude、Gemini)的输出进行自一致性校验,显著降低了决策的方差和错误率 。

领域语言桥接与分层存储机制

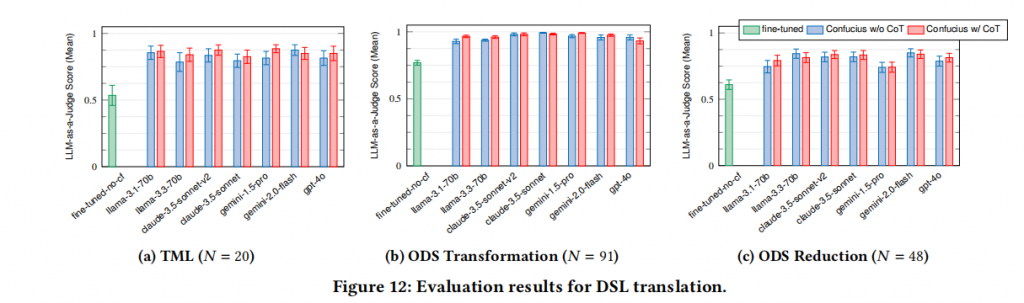

Confucius 成功的关键在于它不直接生成低级的 CLI 指令,而是通过 领域特定语言(DSL) 作为中间桥梁 。论文识别了网络领域最常用的三种 DSL:用于拓扑图修改的 TML、用于网络时间序列数据查询的 ODS,以及用于网络数据模型定义的 Robotron 。通过内置的 Translator 模块,LLM 只需生成高层的 DSL 代码,再由各领域的专用编译器转化为物理配置 。这种“代码即推理”的方式不仅便于人类审计,还能利用现有的编译器进行语法验证 。

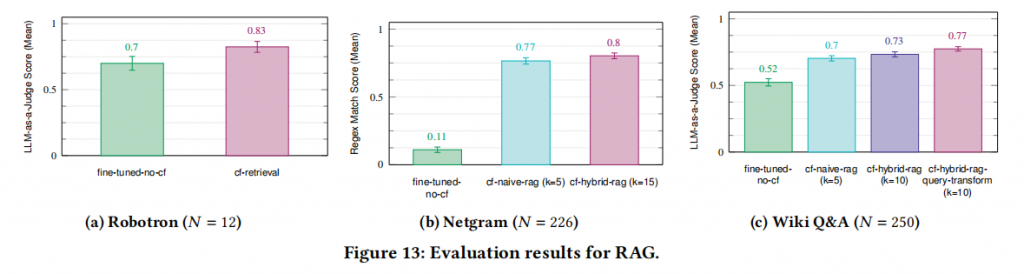

在存储管理方面,Confucius 区分了长短期记忆。短期记忆 使用消息树结构,完整记录了多轮对话和各智能体间的交互上下文 。长期记忆 则利用 检索增强生成(RAG) 技术 。面对 Meta 内部数以百万计的网络数据模型和技术文档,Confucius 构建了一个基于向量数据库的大规模索引系统 。通过混合检索(Hybrid RAG)和查询转换技术,LLM 可以在毫秒级从海量文档中提取出与当前操作最相关的上下文,从而在不增加 Token 成本的前提下提升了处理复杂、长周期任务的能力 。

生产实践评估与安全性校验

在长达两年的生产运行中,Confucius 展现出了显著的工业价值。评估数据显示,该框架平均每周为每位应用开发者节省了约 17 个工程师小时 。在 DSL 转换等关键指标上,Confucius 相比于纯基础模型,准确率提升了高达 21% 至 35% 。这种提升主要归功于其领域感知的 Prompt 工程和多模型集成策略 。此外,RAG 模块在处理数百万个向量的知识库查询时,其准确性也远优于针对特定领域微调(Fine-tuned)后的单一模型 。

安全性是 Confucius 设计中的重中之重。系统集成了多重验证机制:包括对生成的 DSL 进行语法解析(Built-in Parser)、在实际下发前进行 API 模拟运行(Dry run),以及针对拓扑修改的图验证器 。此外,考虑到隐私合规,Confucius 引入了预处理脱敏步骤,会自动识别并替换请求中的 IP 地址、用户名等敏感信息(PII),并在模型回复后还原,确保数据不会泄露给第三方 LLM 提供商 。这种全方位的安全防护网,使得 AI 能够安全地介入生产网络的核心变更流程。

总结与针对“大小模型 + RL”协同的创新思考

综上所述,Confucius 提供了一个 LLM 落地工业网络的经典范式:以大模型为意图引擎,以多智能体为执行逻辑,以 DSL 为安全边界。结合您之前关于 “大小模型协同 + 强化学习” 的创新点,Confucius 的经验可以进一步延伸:

- 分层闭环优化:可以将 Confucius 作为“慢思考”层(高层意图与 DAG 规划),而将强化学习(RL)Agent 作为“快思考”层(底层实时调优)。LLM 负责定义 RL 的奖励函数(Reward)和探索边界,RL 则在 LLM 给出的安全框架内进行毫秒级的流量控制。

- 模型蒸馏与部署:Confucius 目前主要运行在云端大模型上,但对于网络边缘(Edge)或交换机内部,可以利用 LLM 生成的高质量数据来蒸馏小型专业化模型(SLM),使其具备特定协议的快速解析能力。

- 自主学习的自动化流程:未来的创新点可以在于让 LLM 自动观察 RL 训练的效果,通过分析训练曲线自动修改网络 DSL 配置或拓扑结构,形成一个“LLM 指挥、SLM 执行、RL 持续进化”的完全自治网络体系。